Onlyness e leadership: perché il change management non funziona più

Ho ascoltato in questi giorni il podcast con Nilofer Merchant in cui torna sul concetto che porta avanti da anni, quello che lei chiama onlyness, e lo applica a un’idea che mi sembra meriti più attenzione di quella che riceve in Italia: la fine del change management come l’abbiamo conosciuto. Merchant viene da una carriera lunga in Apple e Autodesk, ha lanciato oltre cento prodotti, è una delle voci più riconosciute sul Thinkers50, e da qualche tempo dice una cosa precisa. Il change management, inteso come piano che parte dall’alto e si distribuisce sotto, è uno strumento del Novecento. Funzionava in un mondo in cui chi stava in cima sapeva la direzione e chi stava sotto doveva essere portato a seguirla, con la giusta combinazione di leve di influenza, comunicazione e formazione. Era un sistema di controllo travestito da accompagnamento.

Quel mondo, dice Merchant, non esiste più. Esiste un altro mondo in cui la conoscenza necessaria per cambiare un’organizzazione non sta più tutta in cima ed esiste quasi sempre distribuita nei nodi, perché sono i nodi quelli che toccano i clienti, i prodotti, le anomalie, le opportunità invisibili dal piano direttivo. Allora il cambiamento non si gestisce più. Si co-crea. E il ruolo della leadership si trasforma da quello di chi indica la rotta a quello di chi sa porre le domande giuste e accetta di non sapere ancora la risposta.

Il sapere si è spostato, i framework no

Per anni ho visto progetti di trasformazione organizzativa fallire per la stessa ragione di fondo, quella che adesso Merchant nomina bene. C’era una sproporzione tra chi disegnava il cambiamento e chi lo doveva attuare. Quelli che lo disegnavano sapevano abbastanza di strategia ma poco del lavoro reale, quelli che lo dovevano attuare sapevano del lavoro reale ma erano tenuti fuori dal disegno. Il classico tentativo di sanare lo squilibrio era introdurre cicli di workshop, focus group, sondaggi di engagement. Roba che dava al sotto l’illusione di partecipare al sopra senza spostare davvero la decisione. Funzionava, a tratti, perché il sotto accettava la finzione in cambio di un po’ di considerazione.

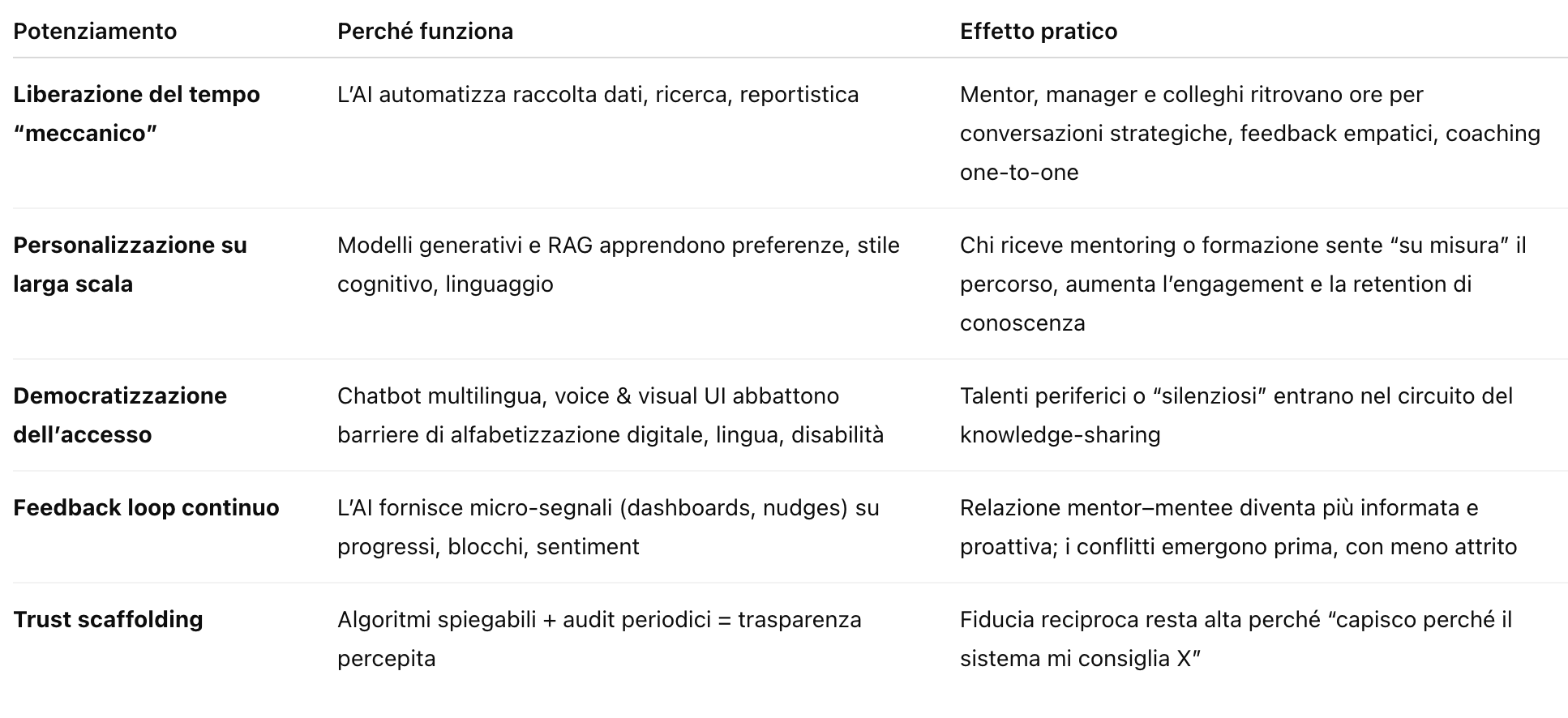

Adesso quella finzione si rompe da sola, e non per ragioni etiche ma per ragioni di efficienza. L’AI sta amplificando un fenomeno che già era in corso da vent’anni: la conoscenza utile per prendere decisioni si è spostata verso i bordi dell’organizzazione. Strumenti come Claude, Copilot, e tutti i loro fratelli, mettono nelle mani di chi sta nei nodi capacità di analisi, sintesi, prototipazione che fino a ieri richiedevano staff dedicato. Una persona junior con un modello potente accanto può oggi produrre output decisionali che dieci anni fa erano appannaggio di consulenti senior pagati a giornata. Allora la domanda diventa imbarazzante: perché continuiamo a gestire il cambiamento come se la conoscenza fosse ancora gerarchica?

Onlyness applicata alla trasformazione

Il concetto di onlyness di Merchant è la chiave operativa che permette di uscire dall’impasse. Onlyness è il punto unico del mondo in cui solo tu stai, dato dalla combinazione esatta di esperienza, storia, prospettiva, relazioni che hai accumulato. Da quel punto unico puoi vedere cose che nessun altro vede e portare contributi che nessun altro può dare. Vista così, ogni persona in organizzazione è portatrice di onlyness, e l’onlyness non si delega.

Quando trasferisci questa idea al cambiamento organizzativo, succede una cosa interessante. Il piano dall’alto smette di essere un piano. Diventa una cornice: la domanda che si sta cercando di rispondere, il vincolo che bisogna rispettare, l’orizzonte temporale entro cui muoversi. Dentro quella cornice, sono gli onlyness distribuiti a costruire le soluzioni, una accanto all’altra, una sopra l’altra, fino a comporre qualcosa che nessuna mente singola avrebbe potuto disegnare. Il ruolo di chi guida diventa custodire la cornice, non riempirla. Tenere fermo il perché, lasciare aperto il come.

Sembra astratto e invece è molto operativo. Vuol dire che il leader passa la maggior parte del tempo a fare due cose: a formulare e riformulare la domanda finché diventa abbastanza precisa da orientare l’azione senza essere così stretta da chiudere lo spazio creativo, e a costruire le condizioni in cui le persone si sentono sicure abbastanza per portare il proprio punto unico al tavolo senza paura. La seconda cosa è la più difficile, perché va contro decenni di abitudini gerarchiche.

Onlyness e disagio: il segnale che qualcosa sta davvero cambiando

Merchant parla del disagio come componente strutturale del processo. Non lo vede come effetto collaterale da minimizzare, lo vede come segnale che si sta andando nella direzione giusta. Se durante un processo di cambiamento nessuno sta scomodo, allora con buona probabilità non sta cambiando niente di vero. Sta cambiando solo la superficie, magari i diagrammi, magari le nomenclature, magari i punteggi negli engagement survey. Ma sotto, le vecchie posizioni di potere stanno tenendo botta.

Il disagio vero arriva quando chi era abituato a decidere deve imparare ad ascoltare prima di parlare, quando chi era abituato a eseguire deve imparare a proporre, quando chi era abituato a sapere deve riconoscere apertamente che non sa. Sono tre disagi simmetrici, distribuiti nei tre livelli classici dell’organizzazione, e nessuno dei tre è gratis. Merchant non promette una scorciatoia. Dice che il leader serio è quello che lo accetta e ci convive, anziché cercare di anestetizzarlo con metodologie sempre più sofisticate.

Leader e onlyness: la nuova base dell’autorità

Nel mio libro La mente adattiva avevo cercato di descrivere come la capacità di adattamento individuale e organizzativo stesse diventando la competenza chiave del decennio. Adesso vedo che quella tesi ha bisogno di un’integrazione. L’AI non aumenta solo l’urgenza dell’adattamento, ne cambia anche la natura. Perché l’AI non è uno strumento che aspetta l’istruzione, è un agente che propone. Lavora con te, ti porge alternative, ti contesta assunzioni. Se sai usarla, è come avere accanto un collega che ha letto tutto ed è disposto a discutere all’infinito.

In quel quadro, l’organizzazione gerarchica vecchio stampo diventa un collo di bottiglia evidente. Se ogni nodo dell’organizzazione ha accesso a un partner di ragionamento di livello globale, il freno smette di essere informativo e diventa autorizzativo: non manca più la conoscenza, manca il permesso di usarla. La burocrazia interna che doveva proteggere dalla cattiva decisione adesso protegge dalla decisione e basta. E intanto i competitor più piccoli, più piatti, più disposti a co-creare, si muovono prima.

Cosa succede a chi guida quando questo si avvera? Succede che il modello mentale del leader come ultimo decisore informato non regge più. L’AI sa più cose di te, su quasi tutto. I tuoi collaboratori, ben armati di AI, sanno più cose di te sui loro ambiti specifici. La tua autorità non può poggiare sul “sapere di più”, perché è semplicemente falso. Deve poggiare su qualcos’altro: sulla qualità delle domande che fai, sulla precisione con cui custodisci la direzione, sulla capacità di tenere viva la coesione del gruppo quando tutti sanno troppe cose e nessuno sa quella decisiva.

Come si forma il prossimo livello di leadership

Se la co-creazione è davvero il nuovo paradigma e l’AI lo accelera, allora va riaperta la questione su come si forma il prossimo livello di leader. Le vecchie palestre, le carriere lineari, gli step da middle a top management, presupponevano un mondo in cui si saliva accumulando sapere e contatti. Adesso il sapere è distribuito e i contatti li media spesso un algoritmo. Quello che resta scarso, e che diventa quindi il vero asset, è la capacità di stare nel disagio della non-conoscenza, di formulare domande che muovono persone e organizzazioni, di tenere insieme talenti diversi intorno a un perché che regge.

Tre cose che non si imparano leggendo, si imparano facendo, in mezzo agli altri, fallendo davanti a loro qualche volta. Mi piacerebbe vedere più aziende che progettano percorsi di leadership su queste tre dimensioni invece che sulla classica triade conoscenze-competenze-soft skill. Sarebbe già un primo passo verso il post-change-management che Merchant prefigura. Per ora, da imprenditore che ha attraversato cambiamenti organizzativi di vari ordini di grandezza, dico che il problema più sottile sta nel cambiare l’idea che abbiamo del leader, prima ancora delle regole. E quella, le regole, non basta a smuoverla.

Se vuoi confrontarti su come riprogettare ruoli di leadership in un contesto in cui l’AI ridistribuisce la conoscenza nei nodi, c’è la pagina Advisory con i formati di collaborazione che propongo a CEO e leadership team.

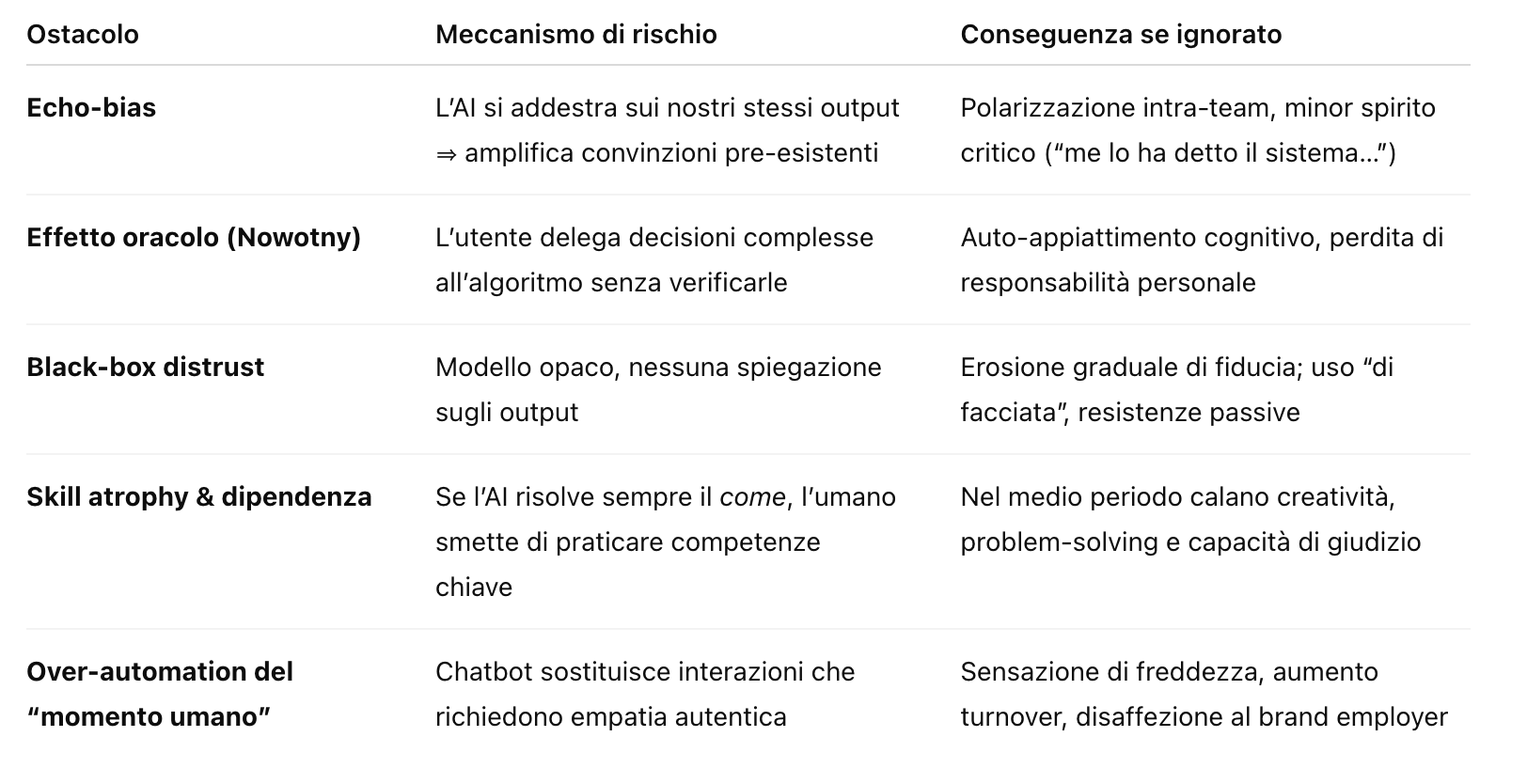

Ma gli stessi algoritmi, se introdotti come black box opache o come meri strumenti di taglio dei costi, rischiano di trasformarsi in erosori di relazione: possono rafforzare i bias di conferma, indurre i leader ad abdicare alla responsabilità, atrofizzare il “muscolo dell’apprendimento” e impoverire la sicurezza psicologica necessaria al confronto onesto. I team allora obbediscono in apparenza, ma interiormente diffidano sia dello strumento sia di chi lo ha imposto.

Ma gli stessi algoritmi, se introdotti come black box opache o come meri strumenti di taglio dei costi, rischiano di trasformarsi in erosori di relazione: possono rafforzare i bias di conferma, indurre i leader ad abdicare alla responsabilità, atrofizzare il “muscolo dell’apprendimento” e impoverire la sicurezza psicologica necessaria al confronto onesto. I team allora obbediscono in apparenza, ma interiormente diffidano sia dello strumento sia di chi lo ha imposto.