Magnifica Humanitas: Leone XIV e il bivio dell’IA

Al centro di Magnifica Humanitas, la prima enciclica di Leone XIV, ci sono due immagini bibliche contrapposte. Una è la torre di Babele, costruita per toccare il cielo e per farsi un nome, fatta crollare nella confusione delle lingue. L’altra sono le mura di Gerusalemme che Neemia ricostruisce dopo l’esilio, pezzo per pezzo, affidando a ciascuna famiglia un tratto. Babele come progetto di potere, uniformità, autosufficienza. Gerusalemme come opera lenta e distribuita, fondata su responsabilità condivisa.

Quando oggi ho letto questa coppia di immagini, nelle prime pagine di Magnifica Humanitas, mi sono accorto che la stessa polarità l’avevo descritta in modo diverso quando ho scritto il mio libro Pelle Digitale ormai qualche mese fa, ma con altri nomi.

Babele per me si chiama “megastruttura accidentale”, riprendendo Bratton. Gerusalemme l’ho chiamata “umanesimo aumentato”. Stesso concetto, lessico diverso, e la cosa mi ha stupito non poco: c’è poco da stare sereni e pensare che sia un caso se una visione tecnologica converge con una visione teologica e spirituale. È un segnale, probabilmente, che il tempo del dibattito puramente tecnico è finito o sicuramente ormai superato.

Cosa dice Magnifica Humanitas

Leone XIV non scrive contro la tecnica e a mio avviso nemmeno contro l’AI. La inserisce dentro un quadro di responsabilità che le tecnologie da sole non possono darsi. L’impalcatura di tutto il testo si regge su cinque punti.

Il primo è la denuncia del paradigma tecnocratico, già al centro di Laudato si’, qui aggiornato all’IA con un’accentuazione nuova. Al paragrafo 95 il Papa scrive che il controllo di piattaforme, dati e capacità di calcolo non appartiene più agli Stati ma a grandi attori economici e tecnologici “che, di fatto, fissano le condizioni di accesso”. Lo dice un Papa, ma potrebbe averlo scritto Shoshana Zuboff, sociologa ed economista americana, professoressa dell’Harvard Business School che è diventata un riferimento centrale del dibattito critico sul digitale per via di un libro del 2019, The Age of Surveillance Capitalism (in italiano Il capitalismo della sorveglianza, Luiss University Press), considerato uno dei testi più influenti dell’ultimo decennio su economia digitale e potere delle piattaforme.

Il secondo punto è un’antropologia del limite contro transumanesimo e postumanesimo. I sistemi di IA, scrive al paragrafo 99, “imitano alcune funzioni dell’intelligenza umana” ma non hanno esperienza né corpo, non hanno coscienza morale. Non capiscono ciò che producono. La distinzione fra imitare e capire diventa il fulcro di un’intera argomentazione che oppone la pienezza umana, fatta di limite e relazione, alla promessa di un potenziamento illimitato.

Il terzo punto è la fenomenologia delle nuove schiavitù digitali. Ghost worker che etichettano dati per pochi centesimi, adolescenti che lavorano nelle miniere di terre rare, reti criminali che usano profilazione e pagamenti anonimi per la tratta, neocolonialismo dei dati sanitari estratti dal Sud globale sotto l’etichetta della ricerca. Su tutto questo, ai paragrafi 173-178, c’è un passaggio in cui il Papa chiede sinceramente perdono a nome della Chiesa per il ritardo storico sulla condanna della schiavitù, e usa quel precedente come monito a queste nuove forme di schiavitù.

Il quarto punto salda epistemologia e democrazia. Senza ricerca condivisa della verità dei fatti, la vita democratica si svuota. Hannah Arendt viene citata direttamente: il suddito ideale dei totalitarismi è chi non distingue più fra fatto e finzione. La disinformazione non nasce con l’IA, ma trova in questa un moltiplicatore.

Il quinto punto è il disarmo dell’IA. Rifiuto delle armi autonome letali, critica all’idea che il giudizio morale possa essere ridotto a calcolo, controllo umano effettivo come condizione non negoziabile. Qui dentro c’è il paragrafo 107, uno dei più affilati, complessi e delicati del testo, che secondo me dovrebbe leggerlo chiunque sviluppa modelli: non basta moralizzare la macchina, allinearla a valori umani, se non si discute chi decide quei valori. La domanda dell’alignment, scrive Leone XIV, non è un tema tecnico ma politico.

Sette nodi dove mi ritrovo in quello che scrivo spesso

Il primo nodo è il paradigma tecnocratico. In Pelle Digitale apro descrivendo Apple, Google e Amazon come “signori della gabbia dorata”, architetti di ecosistemi che catturano l’esperienza e la monetizzano. L’enciclica al paragrafo 95 arriva alla stessa diagnosi da un lessico apparentemente opposto. Io descrivo un meccanismo, fatto di estrazione di dati, monetizzazione, lock-in degli utenti. Il Papa nomina un peccato: idolatria del profitto, dominio sull’altro, pretesa di autosufficienza. Linguaggi differenti che vengono da tradizioni che da secoli non si parlano, e che improvvisamente convergono sulla stessa fotografia: pochi attori privati che decidono per tutti, con strumenti opachi e responsabilità diluite.

Poi c’è l’ambiente. Io lo chiamo “pelle digitale” e “sistema nervoso invisibile” e intendo lo strato che avvolge persone, oggetti e città. Leone XIV al paragrafo 76 parla esplicitamente di “ecosistema digitale” che, come l’ambiente naturale, può essere custodito o sfruttato, condiviso o monopolizzato. La metafora ambientale, applicata al digitale, è uguale.

Il terzo nodo è l’opacità algoritmica. Nel capitolo 7 del libro io racconto i bias, facendo degli esempi in particolare cito COMPAS sulla recidiva e il caso del recruiting di Amazon, e arrivo a parlare di “teocrazia digitale” per descrivere algoritmi-divinità che decidono senza dover dare spiegazioni. L’enciclica, ai paragrafi 102-107, costruisce la stessa argomentazione con parole più “sobrie”: black box, accountability, catena di responsabilità non delegabile alla macchina. Il Papa non usa “teocrazia”. Ma il problema che descrive è esattamente quello a mio avviso.

Quarto nodo: i ghost worker. Nel libro dedico una pagina alla materia che si nasconde dietro l’immaterialità apparente del cloud e al lavoro umano che c’è dietro. Una catena globale di corpi e luoghi che regge la leggerezza apparente di una risposta generata in due secondi. Il paragrafo 173 di Magnifica Humanitas entra in questa anatomia con una forza che pochi documenti pubblici hanno. Leone XIV scrive che ogni risposta dell’IA proviene da “una lunga catena di mediazioni” che include risorse naturali, infrastrutture energetiche e persone. Nomina la fatica invisibile di chi etichetta dati e modera contenuti per compensi minimi, “spesso giovani donne”. Aggiunge l’estrazione delle terre rare, dove “adolescenti e bambini lavorano in condizioni pericolose”. E chiude con la frase che spacca la sezione: “corpi segnati, mutilati, consumati perché il flusso del calcolo non si interrompa”.

Quando un Papa nomina i corpi mutilati dentro un’enciclica sull’intelligenza artificiale, sta facendo un’operazione che nessun rapporto o paper accademico può fare: mette la materia umana al centro morale del dibattito, e non ai suoi margini. La conseguenza al paragrafo 174 è esplicita e a mio avviso centrale: una tecnologia che promette emancipazione ma produce nuove forme di subordinazione globale contraddice il principio fondamentale della dignità della persona.

C’è poi tutto il tema della mente estesa, attenzione catturata, forme di dipendenza che ne derivano. Nel capitolo 4 io ho scritto della cognizione distribuita di Andy Clark, e nel capitolo 6 sull’economia dell’attenzione progettata per catturarci. L’enciclica ai paragrafi 100 e 170 parla di “delega” cognitiva e di modelli imprenditoriali che “prosperano sulla debolezza umana”. Qui c’è uno scarto interpretativo che vale la pena tenere aperto: Clark vede nell’estensione un guadagno, il Papa la legge come rischio. E a mio avviso tutte e due sono vere.

Sesto, c’è il tema dello human-in-the-loop, che ho dichiarato pilastro del capitolo finale del libro. L’enciclica, parlando di IA militare al paragrafo 200, usa la stessa nozione con parole quasi sovrapponibili: la forza letale non può essere delegata a processi automatizzati, deve restare sotto “un controllo umano effettivo, consapevole e responsabile”.

Settimo, il più delicato a mio avviso. L’alignment come questione politica. Nel libro parlo di ethics by design e cito Stuart Russell sull’allineamento ai valori umani. Il Papa al paragrafo 107 fa un passo che la letteratura tecnica raramente fa: chiede chi decide quei valori. Se l’allineamento è una scelta morale, è una scelta che non può essere appannaggio di pochi laboratori. È un punto della discussione che sposta tutta la conversazione sull’IA dall’ingegneria alla politica, e lo fa con una precisione che dovrebbe far riflettere chi lavora su questi temi.

Dove Magnifica Humanitas va ben oltre le riflessioni comuni

Il primo punto è la questione delle armi autonome. Io ne parlo in modo leggero nel capitolo sull’agency degli agenti, ma non la centro. Leone XIV le mette al cuore di un intero capitolo, riconosce che la riabilitazione contemporanea della guerra come strumento di politica internazionale è uno dei segni più gravi del tempo, e collega il riarmo all’IA in modo che dieci anni fa sarebbe stato impensabile. Ha ragione e condivido pienamente, gli scenari ibridi e gli attacchi cyber stanno cambiando la grammatica dei conflitti, e non si può parlare di etica dell’IA senza arrivare a parlare di questo.

Il secondo è il neocolonialismo dei dati sanitari. Nel libro descrivo l’asimmetria della medicina basata su dati, ma resto sul piano dell’individuo. L’enciclica al paragrafo 178 lo allarga ai popoli: chi possiede oggi i dati sanitari di intere popolazioni, raccolti sotto il segno della ricerca, “possiede in realtà una leva strutturale sul futuro”. È una lettura geopolitica dell’estrazione dei dati che a gennaio, quando ho pubblicato il libro, per quanto ne fossi consapevole non ho pensato di affrontare.

Il terzo, e forse il più importante, è la memoria storica. Il Papa usa il ritardo con cui la Chiesa ha condannato la schiavitù come monito sul presente: se non vogliamo chiedere perdono in futuro per non aver visto le nuove asimmetrie di oggi, dobbiamo nominarle adesso. È una valutazione che solo un’istituzione con quel tempo lungo può fare. La riflessione laica contemporanea, la mia compresa, ha una memoria corta. Senza memoria lunga, certe asimmetrie restano fuori dal campo visivo.

E poi c’è il nodo del lavoro

C’è un punto su cui Leone XIV passa, e su cui non ho una posizione netta. È il capitolo sul lavoro, paragrafi 148-169, praticamente la parte più operativa di tutta l’enciclica a mio avviso e quella che parla più direttamente al mondo dell’impresa e della trasformazione digitale.

Il Papa cita san Benedetto e l’ora et labora, parla del lavoro come cammino di maturità e realizzazione. Al paragrafo 148 “lavoro” significa opera e contributo, fatica che ha senso, attività con cui prolunghiamo in qualche modo l’opera del Creatore. Ma già al paragrafo 149 la parola scivola sull’occupazione retribuita che produce sostentamento.

Un’ambiguità antica, che la Dottrina Sociale trascina dalla Rerum Novarum del 1891 in poi, e che oggi pesa, perché tiene insieme due cose che dovremo scindere con intelligenza.

Lo scenario che mi interessa, e che discuto da tempo con un amico parroco con cui non sono d’accordo, è quello in cui l’automazione derivante da AI e Robot libera davvero l’umanità dalla necessità di lavorare per sussistere. È uno scenario plausibile, forse il più radicale (e ottimista per certi versi). In quel mondo un reddito universale di base diventa obbligo strutturale prima ancora che scelta politica: senza, l’IA produce solo concentrazione di ricchezza e povertà di massa. E se la base materiale è garantita, si apre uno spazio per un altro tipo di lavoro, fondato su contributo e non su scambio. Il lavoro dei monaci copisti che hanno salvato la civiltà occidentale tra il VI e il XII secolo. Il lavoro delle madri che crescono i figli. Il lavoro dei volontari che reggono le associazioni, dei contributori di codice open source, dei ricercatori che pubblicano senza ricavarne nulla. Nessuna di queste attività è retribuita. Tutte sono lavoro nel senso pieno benedettino del termine.

Il mio amico Don Michele la pensa diversamente. Non esiste dignità senza lavoro, mi ripete ogni volta che ne parliamo, e lo dice con una fermezza esperienziale prima che ideologica. Vede ogni giorno cosa succede alle persone che il lavoro lo perdono o non lo trovano. Vede come si perde il senso di sé. Per lui il lavoro è un dato antropologico, non un dettaglio economico: è la forma stessa attraverso cui l’essere umano matura e si riconosce. Ed è qui che la sua tradizione e la mia visione del futuro si incontrano in modo costruttivo, perché ha ragione anche lui, su un pezzo del problema che spesso chi ragiona di reddito universale rimuove.

L’essere umano matura attraverso il fare che ha conseguenze. Senza un’opera che lo metta in rapporto con la realtà, con i limiti dei materiali, con il giudizio degli altri, con la propria fatica, la dignità diventa un’astrazione interiore che non regge. La tradizione cristiana lo sa da Genesi in poi, l’uomo è collaboratore della creazione e non spettatore. E sociologicamente succede esattamente quello che il mio amico vede sul campo: nelle comunità dove l’occupazione collassa senza essere sostituita da altre forme di contributo riconosciuto, le persone non fioriscono, si rovinano, entrano in forme diverse di collisione sociale. Le ricerche sulle zone deindustrializzate americane, sui quartieri operai italiani dopo le chiusure delle fabbriche, lo confermano. Se le persone non si sentono utili, tutto collassa.

Magnifica Humanitas apre un varco proprio su questo nodo. Al paragrafo 154 Leone XIV scrive che una società che garantisse occupazione solo a una minoranza esporrebbe molti a “inattività forzata, assenza di responsabilità, mancanza di impegni e stimoli quotidiani, con esiti di impoverimento umano e culturale in contrasto con l’elevato livello di sviluppo tecnico”. Lo chiama “paradosso di progresso materiale e regressione antropologica”. E conclude che è necessario “ripensare il lavoro stesso e il suo rapporto con la cittadinanza, perché l’assenza di occupazione non pregiudichi la partecipazione sociale”. Il Papa non sta dicendo che senza occupazione retribuita non c’è dignità. Sta dicendo che la nozione novecentesca di lavoro, quella che lega stipendio e dignità in un nodo unico, sta diventando inadeguata e va sciolta con cura.

Il “lavoro” come lo intendiamo oggi, un’attività salariata separata dalla vita domestica, misurata in ore, scambiata sul mercato del lavoro, è un’invenzione industriale di duecento anni.

Prima c’erano contadini e artigiani, monaci e madri di famiglia, scribi e copisti. Tutte figure che producevano valore senza essere “occupate” nel senso novecentesco. Hannah Arendt nella Condizione umana distingue tre cose. Labor, la fatica per sopravvivere. Work, la creazione di opere durevoli. Action, l’azione che lascia traccia nel mondo umano. Solo il primo è lavoro nel senso economico stretto. Gli altri due sono ciò che intendo quando parlo di un lavoro non remunerato fatto di passione e contributo.

Da Arendt in poi sappiamo che la dignità del lavoro stipendiato novecentesco era un fascio di tre cose tenute insieme. Un fare che incontra resistenza reale: i materiali e il tempo, la fatica, il giudizio degli altri. Senza questo l’identità si squaglia. Un riconoscimento sociale del valore di quel fare. Senza questo l’attività diventa hobby privato e non sostiene la dignità pubblica. Una base materiale di sussistenza che permetta di farlo senza disperazione. Senza questa, ogni discorso su “passione e ambizione” è privilegio per ricchi. Il salario industriale offriva i tre insieme, e questo ne ha fatto il modello dominante per due secoli. L’errore di chi parla solo di reddito universale, il mio compreso quando alleggerisco troppo il discorso, è pensare che la sola base materiale basti. L’errore opposto, di chi difende una visione ottocentesca del lavoro, è pensare che solo il lavoro retribuito possa fornire le altre due.

C’è poi un nodo geografico che l’enciclica nomina al paragrafo 153 e che vale la pena ripetere. La transizione non procederà in modo omogeneo. Le società ricche si automatizzano caoticamente e producono disoccupazione. Vaste regioni del Sud globale restano intrappolate in quelle che Leone XIV chiama “economie ibride” dove lavoro umano sottopagato e tecnologie parziali convivono senza mai trasformarsi davvero. Diventano serbatoi di manodopera precaria e focolai di migrazioni forzate. Il discorso sul futuro del lavoro va sempre tenuto a due velocità, perché chi parla di reddito universale spesso parla da Paesi ricchi e dimentica che intere economie del pianeta non hanno mai conosciuto il salario industriale come modello.

Siamo all’inizio di una transizione in cui dobbiamo inventare istituzioni che riconoscano come lavoro il fare non retribuito. Se non lo facciamo, la sostituzione algoritmica del lavoro stipendiato sarà una catastrofe antropologica, e su questo l’enciclica ha ragione a essere allarmata. Se lo facciamo, può essere lo spostamento di senso del lavoro più grande dai tempi della riforma benedettina. La domanda concreta, quella che resta aperta, è questa: quali istituzioni possono oggi riconoscere come dignità il lavoro non remunerato? La parrocchia ne è una storica. L’associazione di volontariato un’altra. La famiglia estesa un’altra ancora. Sono tutte istituzioni in crisi, ognuna per ragioni sue. Servono forme nuove, e quelle vecchie vanno rigenerate. Su questo l’enciclica è ambigua secondo me, e credo che il prossimo passo della Dottrina Sociale dovrà essere più esplicito di quanto Leone XIV osi oggi in questa enciclica.

Cosa cambia, se cambia qualcosa

Chi sviluppa e finanzia IA, chi la regola, non può più dichiararsi “tecnico” come schermo. Il paragrafo 209 dell’enciclica chiama in causa scienziati e imprenditori, investitori e autorità accademiche, politici. Quando ci si limita a guardare al proprio settore, scrive Leone XIV, ci si illude di svolgere un compito moralmente neutro. Mi ci ritrovo perfettamente, perché è la stessa argomentazione che faccio nel manifesto finale del libro: il fallimento etico è un fallimento progettuale.

La responsabilità progettuale, che chiamo ethics by design, l’enciclica la riformula come responsabilità condivisa fra istituzioni capaci di regolare, imprese che riconoscono nel lavoro e nella dignità un criterio di successo, corpi intermedi che ricostruiscono fiducia.

C’è un altro elemento operativo che vale la pena segnalare, perché passa sottotraccia ma c’è e non è sottovalutabile. Magnifica Humanitas al paragrafo 159 chiede esplicitamente di superare il Prodotto Interno Lordo come metrica unica dello sviluppo. Servono, scrive Leone XIV, parametri complementari capaci di misurare dignità del lavoro, prosperità condivisa, riduzione delle disuguaglianze, salvaguardia ambientale. Per chi lavora in impresa e si confronta ogni trimestre con KPI finanziari, è un invito a chiedersi quali metriche stiamo davvero usando per misurare il successo dei progetti tecnologici che lanciamo.

Lo stesso vale per il paragrafo 163, dove il Papa elenca quattro criteri operativi che diventano una check-list utile per chi progetta sistemi di IA che incidono su persone. Trasparenza e responsabilità nelle decisioni algoritmiche che riguardano accesso al credito e al lavoro, ai servizi essenziali. Inclusione e accesso ai benefici dell’innovazione, perché la tecnologia non allarghi il divario fra chi ha e chi non ha. Misure di equità che correggano gli squilibri creati dalla concentrazione di ricchezza e potere. Cooperazione internazionale, perché molte decisioni economiche superano i confini degli Stati. Sono cose verificabili, più che principi generici. E sono il vero terreno comune fra una riflessione laica sulla tecnologia e la Dottrina Sociale aggiornata.

Nessuno di noi che lavora su queste materie ha gli strumenti per agire da solo. La convergenza fra tradizioni distanti, su questo, è un dono che vale la pena prendere sul serio.

Neemia ricostruì le mura di Gerusalemme con famiglie diverse, ognuna su un tratto. Nessuna ricostruì l’intera cinta da sola. A chi progetta tecnologia oggi tocca il tratto in cui passa la decisione su cosa deleghiamo, cosa controlliamo, cosa restiamo capaci di giudicare. Il prossimo noi, come scrivevo a chiusura del manifesto di Pelle Digitale, inizia da lì.

Lettera Enciclica Magnifica Humanitas di Papa Leone XIV, 15 maggio 2026.

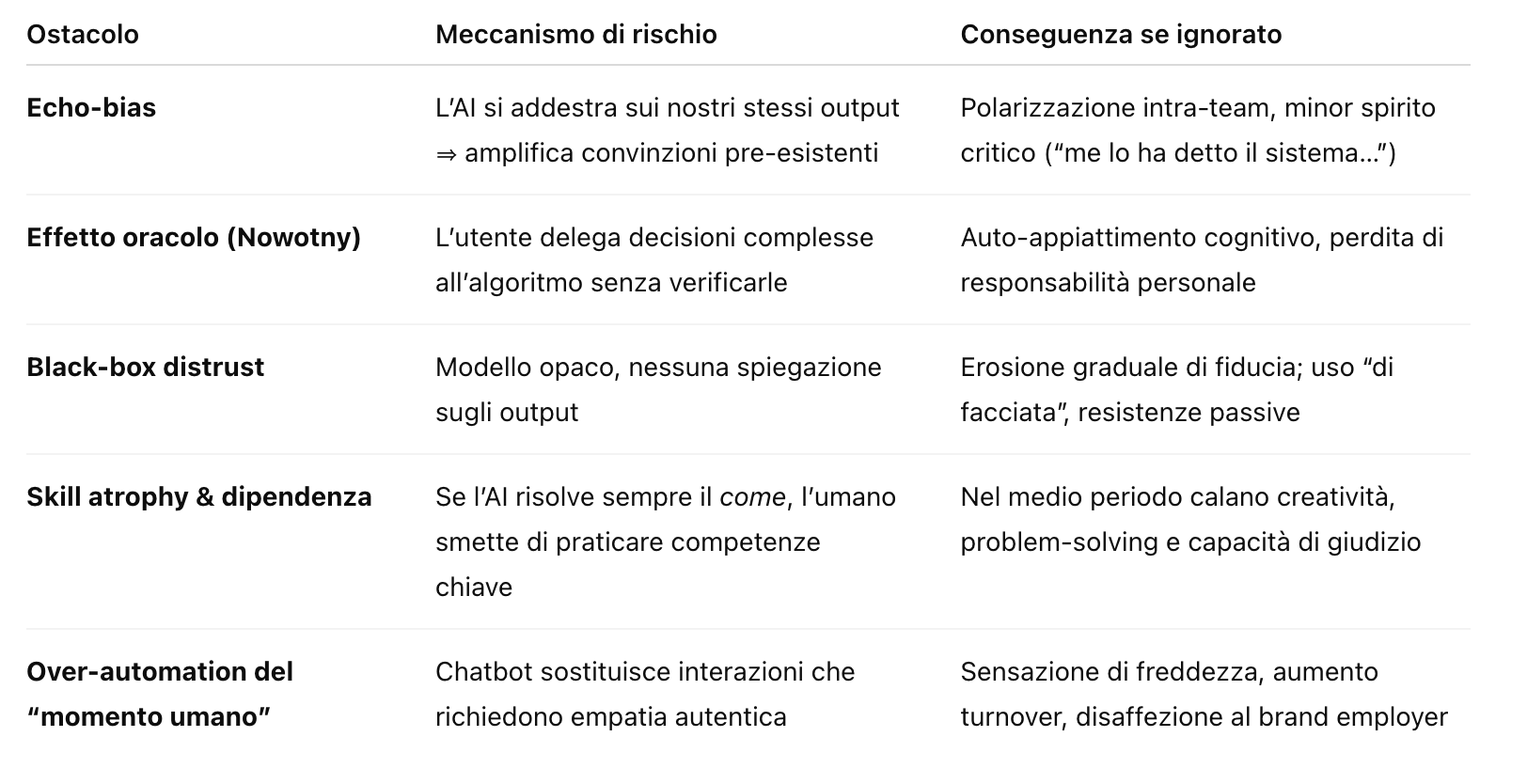

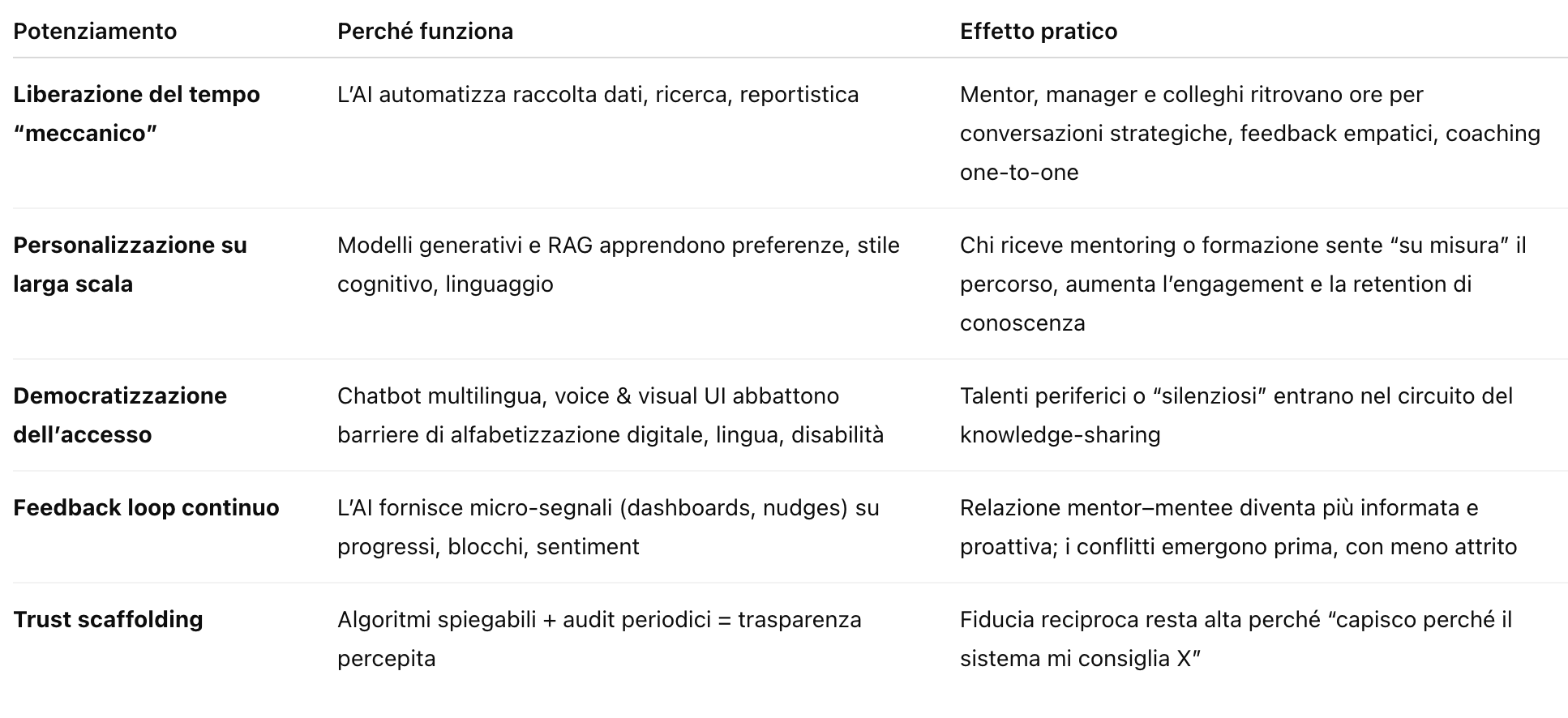

Ma gli stessi algoritmi, se introdotti come black box opache o come meri strumenti di taglio dei costi, rischiano di trasformarsi in erosori di relazione: possono rafforzare i bias di conferma, indurre i leader ad abdicare alla responsabilità, atrofizzare il “muscolo dell’apprendimento” e impoverire la sicurezza psicologica necessaria al confronto onesto. I team allora obbediscono in apparenza, ma interiormente diffidano sia dello strumento sia di chi lo ha imposto.

Ma gli stessi algoritmi, se introdotti come black box opache o come meri strumenti di taglio dei costi, rischiano di trasformarsi in erosori di relazione: possono rafforzare i bias di conferma, indurre i leader ad abdicare alla responsabilità, atrofizzare il “muscolo dell’apprendimento” e impoverire la sicurezza psicologica necessaria al confronto onesto. I team allora obbediscono in apparenza, ma interiormente diffidano sia dello strumento sia di chi lo ha imposto.