Pelle Digitale: quando il mondo diventa interfaccia e l’intelligenza diventa ambiente

Ci sono libri che nascono per spiegare una tecnologia. “Pelle Digitale” pubblicato con EGEA nasce per spiegare una condizione. Una nuova condizione dell’umano, che non riguarda solo chi “lavora nel tech”, ma chiunque viva in un ambiente sempre più intelligente, sensorizzato e predittivo.

L’idea centrale è questa: stiamo entrando in un’era in cui l’intelligenza smette di essere un software che consultiamo e diventa un’atmosfera che respiriamo. Un’infrastruttura invisibile che collega sensori IoT, edge device, algoritmi e modelli in una rete globale. I dati diventano impulsi. Gli oggetti smettono di essere “cose” separate e diventano organi di un ecosistema più grande.

L’idea centrale è questa: stiamo entrando in un’era in cui l’intelligenza smette di essere un software che consultiamo e diventa un’atmosfera che respiriamo. Un’infrastruttura invisibile che collega sensori IoT, edge device, algoritmi e modelli in una rete globale. I dati diventano impulsi. Gli oggetti smettono di essere “cose” separate e diventano organi di un ecosistema più grande.

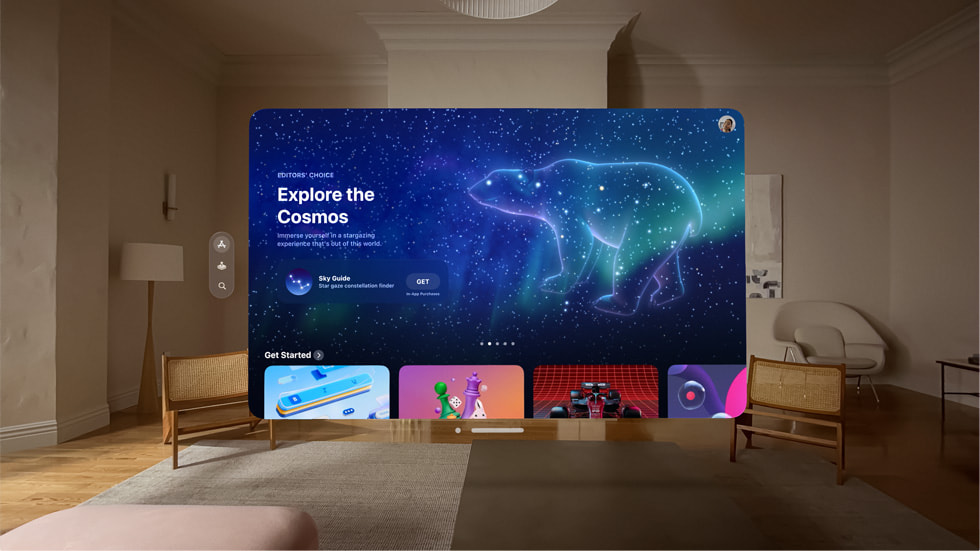

In apertura del libro parlo di transizione profonda: non un upgrade, ma un cambio di paradigma. La tecnologia non si sovrappone più al mondo: si radica nel mondo. Lo spazio diventa interfaccia. L’esperienza diventa persistente e contestuale. La relazione tra fisico e digitale non è più una “connessione”: è una dissoluzione del confine.

Il catalizzatore di questa metamorfosi ha un nome chiave: spatial computing. Non è “solo” AR/VR. È un principio operativo che rende ogni luogo un potenziale punto di accesso: casa, città, oggetti, corpo. È la trasformazione della realtà in un layer interpretato, aumentato e governato da modelli. E quando la realtà diventa un layer, la domanda non è più “quale app userò?”, ma “quale realtà sto abitando?”.

Per raccontare questa trasformazione ho scelto una struttura in otto pilastri, perché lo shift non è monodimensionale: è simultaneo e sistemico. Questi sono i capitoli del viaggio:

-

L’intelligenza invisibile: la rete globale che unifica dispositivi, dati e decisioni.

-

La nuova grammatica dell’interazione: come cambiano i linguaggi tra umani, interfacce e sistemi.

-

Il mondo come interfaccia: la città e lo spazio come UI diffusa.

-

Il corpo e la mente estesa: quando la tecnologia non è “fuori”, ma diventa parte della cognizione.

-

Relazioni aumentate: socialità, identità, presenza e mediazione algoritmica.

-

L’economia dell’attenzione e dell’intenzione: la competizione non è più solo per il tempo, ma per il “volere”.

-

Il paradosso dell’opacità: più sistemi intelligenti, meno comprensione del “perché” dietro le scelte.

-

L’umanesimo aumentato: la necessità di una nuova alleanza tra innovazione e valori umani.

Questa sequenza è intenzionale: parte dall’infrastruttura e arriva alla responsabilità. Perché, a un certo punto, non basta più descrivere il fenomeno. Serve prendere posizione.

Uno degli snodi del libro è il conflitto tra promessa e ombra. Da un lato: un mondo più efficiente, sicuro, personalizzato, capace di anticipare bisogni e amplificare capacità. Dall’altro: controllo pervasivo, delega cognitiva, perdita di autonomia, complessità indecifrabile. La pelle digitale può essere un esoscheletro che ci rende migliori o una gabbia elegante che ci rende docili

Per questo “Pelle Digitale” non si chiude con una sintesi, ma con un Manifesto per un umanesimo aumentato. L’idea è semplice: il futuro non è qualcosa che “ci capita”. È qualcosa che progettiamo, decisione dopo decisione, interazione dopo interazione. E se siamo co-creatori di questo sistema nervoso invisibile, allora siamo anche responsabili della sua direzione.

Quando dico “umanesimo aumentato” non intendo un ottimismo ingenuo. Intendo un compito: riportare l’uomo al centro non come slogan, ma come criterio di design. Vuol dire chiedersi quali valori devono guidare lo sviluppo e l’adozione delle tecnologie; come preservare autenticità dell’esperienza umana in un mondo mediato; come evitare che l’innovazione invisibile diventi un automatismo economico privo di etica.

Come si usa, concretamente, questo libro?

Si usa come lente: per rileggere prodotti, servizi e piattaforme non per feature, ma per impatto sul comportamento e sulla percezione. Si usa come mappa: per capire dove stiamo mettendo intelligenza (e dove stiamo togliendo agency). Si usa come strumento di conversazione: perché lo shift non va affrontato da soli, ma dentro organizzazioni, scuole, istituzioni, famiglie.

Se “Pelle Digitale” ha un obiettivo, è questo: rendere visibile l’invisibile. Dare parole e struttura a ciò che spesso percepiamo solo come ansia diffusa o entusiasmo confuso. E trasformare quella percezione in scelta consapevole: non subire la pelle digitale, ma diventare architetti del modo in cui ci avvolgerà.