Apple, l’AI, il contesto ed il paradosso dell’innovazione e della pazienza.

In questi giorni, il web e i mercati reagiscono con tono deluso al keynote del WWDC 2025: niente AI. Nessuna “AI Apple”. Nessun modello proprietario, nessun assistente rivoluzionario, nessuna dichiarazione forte. Solo aggiornamenti di sistema, funzioni incrementali, nuove integrazioni.

Eppure, se si osserva la storia di Apple con uno sguardo lungo, non dovrebbe sorprenderci. Perché Apple (quasi mai) ha fatto la prima vera mossa. Ma ha sempre fatto quella definitiva.

Il paradosso dell’innovazione tardiva

1998: iMac

- Contesto: i PC erano grigi, complicati, pieni di cavi e direi anche con un’estetica scadente.

- Apple: un solo cavo, design colorato e minimale, USB-only, plug and play. Non inventa il computer, ma reinventa il concetto di accessibilità e desiderabilità.

- E gli altri: Tutti i brand iniziano a spingere su design più curato, semplicità d’uso e porte standardizzate.

2001: iPod

- Contesto: il trend era quello di scaricare (tonnellate) musica da Napster, e ascoltarla in mobilità nei lettori MP3 presenti all’epoca, con storage limitati, interfacce “fisiche” molto più vicine ai vecchi Walkman.

- Apple: “1000 canzoni in tasca” e iTunes. Ecosistema + semplicità + design + sincronizzazione, tutto in uno, ma soprattutto legalità nell’esperienza di ascolto della musica.

- Dopo Apple: Creative, Sony e altri provano a replicare. Ma senza un software come iTunes, l’esperienza resta frammentata.

2007: iPhone

- Contesto: Nokia, Blackberry, Palm dominavano il mercato.

- Apple: interfaccia multitouch fluida, niente tastiera fisica. Il telefono diventa piattaforma.

- Dopo Apple: Android cambia direzione, Nokia crolla, Microsoft inizia un declino nel mondo OS e smartphone. La definizione delle linee guida progettuali per le app impone agli altri ecosistemi un cambio di approccio e miglioramento dell’esperienza.

2008: App Store

- Contesto: gli smartphone erano dispositivi chiusi, con software preinstallato o accessibile solo da accordi B2B.

- Apple: lancia l’App Store, aprendo l’iPhone agli sviluppatori indipendenti con un modello di revenue sharing (70/30), strumenti di sviluppo (SDK), linee guida di design e un processo di review centralizzato.

- Dopo Apple: si crea un’economia digitale completamente nuova, con centinaia di migliaia di sviluppatori e aziende che costruiscono business basati su mobile app. Google risponde con Android Market (poi Play Store), ma con meno controllo qualitativo. Nokia e Microsoft non riescono a costruire ecosistemi sostenibili e perdono il mercato.

2010: iPad

- Contesto: netbook, ebook reader, tablet marginali.

- Apple: crea una nuova categoria tra laptop e smartphone. Mobilità, leggerezza, interfaccia su misura per una esperienza lavorativa o di intrattenimento in una zona intermedia tra smarthone e desktop.

- Dopo Apple: Google, Samsung e Amazon rincorrono con Android, ma senza una UX verticale e coerente non riescono a imporsi allo stesso modo.

2012: Apple TV

- Contesto: la smart TV era un terreno confuso, con interfacce poco fluide e offerte disaggregate.

- Apple: rilancia Apple TV con focus su entertainment integrato, AirPlay, App Store per TV, e un’interfaccia coerente con l’ecosistema iOS, creando una continuità di esperienza tra device personale e connessione con spazio casalingo

- Dopo Apple: Google ristruttura Android TV e lancia Google TV; Amazon investe su Fire TV. Inizia la corsa all’integrazione tra servizi OTT, assistenti vocali e dispositivi domestici.

2014: Apple Watch

- Contesto: smartwatch esistenti (Pebble, Galaxy Gear), ma ancora di nicchia.

- Apple: focus su salute, notifiche, lifestyle e perfetta integrazione con l’iPhone.

- Dopo Apple: Android Wear si adegua, nascono ecosystem health-first (Fitbit, Garmin), ma Apple conquista il segmento premium e sanitario e nel segmento watch (non smart) diventa significativa.

2016: AirPods

- Contesto: cuffiette Bluetooth presenti ma scomode e poco integrate.

- Apple: esperienza seamless, pairing istantaneo, ricarica magnetica nella custodia.

- Dopo Apple: tutti i produttori lanciano TWS, ma nessuno raggiunge la stessa immediatezza d’uso. L’accoppiamento istantaneo diventa lo standard aspirazionale.

2016–2020: Rimozione jack audio, BLE, NFC e FaceID

- Contesto: standard tecnici consolidati ma poco evoluti ed integrati nella vita di tutti i giorni.

- Apple: elimina il jack audio con coraggio strategico; spinge il Bluetooth Low Energy e l’NFC per pagamenti rapidi e sicuri (Apple Pay); introduce il Face ID come nuova soglia d’ingresso, abilitando il Wallet e la digitalizzazione dell’identità.

- Dopo Apple: Samsung inizialmente critica la scelta, poi segue; Android integra NFC payment (fino a prima usato solo per trasferimento dati); il riconoscimento facciale diventa standard.

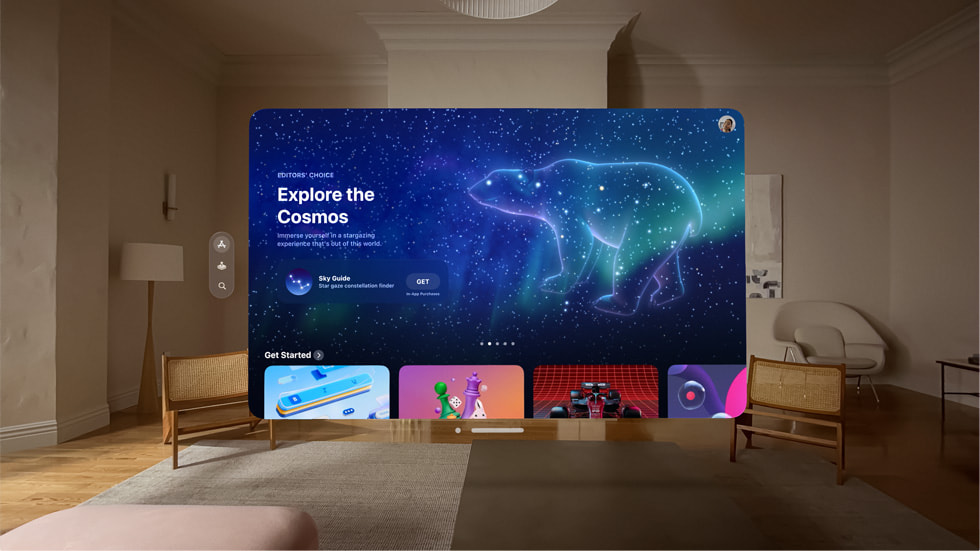

2023: Vision Pro

- Contesto: Oculus, HTC Vive e altri visori AR/VR già sul mercato.

- Apple: introduce lo Spatial Computing, interfaccia oculare e gestuale, contenuti immersivi. Più di un visore, un ambiente personale computazionale, integrato nell’ecosistema di tutti gli altri device.

- Dopo Apple: I competitor cominciano a rivedere le proprie roadmap su AR/VR, integrando eye tracking e ricalibrando il focus sulla produttività immersiva. Samsung e Android, lanciano un dispositivo che utilizza il concetto di powerbank esterno al visore, come introdotto da Apple (elemento contestato da tutti al momento dell’uscita)

2025: LiquidGlass e l’apprendimento dell’interazione futura

- Contesto: UX mobile ancora dominante, esperienze AR/VR in fase esplorativa.

- Apple: inizia a spostare il paradigma verso una realtà aumentata integrata e continua. LiquidGlass (che vorrei segnalare che è in Beta, e come tutte le Beta serve anche a capire e migliorare) non è solo un’interfaccia: è un processo di apprendimento distribuito. L’interazione diventa trasparente e coerente con il reale, predisponendo l’esperienza a quello che evolverà in Vision pro e Glass futuri.

- Dopo Apple: Le Big Tech iniziano a parlare di ambient intelligence e ambient interface. La UX non è più visibile, ma comportamentale.

E poi, Bonus, per non parlare degli impatti della fotocamera e rivoluzione visiva

- Contesto: Le fotocamere sugli smartphone erano accessorie e non centrali.

- Apple: trasforma la fotocamera in uno strumento creativo e relazionale (foto, video, FaceTime, AR), con attenzione a software computazionale e qualità.

- Dopo Apple: tutti i competitor iniziano a investire su AI photography, miglioramento software e sensori evoluti (Samsung ne fa oggi il suo cavallo di battaglia). Il comparto foto/video diventa motore d’acquisto.

L’arte dell’integrazione (e della pazienza)

Apple non è (quasi mai) la prima a inventare una tecnologia. Apple è (quasi sempre) la prima a integrarla in modo tale da trasformarla in un comportamento diffuso, semplice, desiderabile.

Ed il vantaggio competitivo non è solo tecnologico. È esperienziale . Come disse Simon Sinek in un celebre TED Talk: “People don’t buy what you do; they buy why you do it.”

Ogni volta che Apple entra in gioco:

- rende coerente l’esperienza tra hardware, software e servizi.

- elimina attriti cognitivi e le frizioni tecniche.

- costruisce un ecosistema dove ogni prodotto ha senso solo dentro il tutto, nel bene e nel male.

E lo fa con una sensibilità unica per l’interfaccia, per i dettagli invisibili, per il linguaggio. E soprattutto per il contesto.

Il contesto come intelligenza

È proprio qui che entra in gioco l’approccio di Apple all’AI. Nel paper The Illusion of Thinking, Apple “smonta” l’idea che un modello linguistico sia automaticamente “intelligente”, sottolineando come spesso generi illusioni di comprensione prive di reale utilità.

Il report è stato ampiamente criticato: molti lo hanno definito una cantonata, un errore di valutazione, uno studio fuorviante. Ma pochissimi hanno discusso le basi di partenza, dichiarate con chiarezza, e soprattutto lo scopo di quell’analisi. Il vero problema è che tutti hanno guardato il dito, ma non dove Apple sta provando a indicare.

Perché la vera domanda non è “quanto è potente un modello generativo”, ma “quanto può essere utile, efficiente e controllabile nel contesto di un dispositivo reale, personale, limitato in termini di risorse ma sempre acceso e connesso”.

È in quella direzione che Apple a mio avviso sta guardando: l’AI non come entità remota da interrogare, ma come presenza diffusa che si adatta al nostro ambiente e lo anticipa. Una AI capace di vivere sul dispositivo, nel sistema, tra i nostri dati, in modo contestuale, sicuro e trasparente.

Apple non testa modelli per battere benchmark a mio avviso, ma per capire cosa serve davvero quando l’AI deve vivere localmente, sui dispositivi, e adattarsi alla complessità quotidiana dell’utente.

Non si tratterà di avere un assistente. Ma di essere assistiti, senza accorgersene. Non un prompt. Ma un’anticipazione. Non una feature. Ma una nuova grammatica dell’interazione.

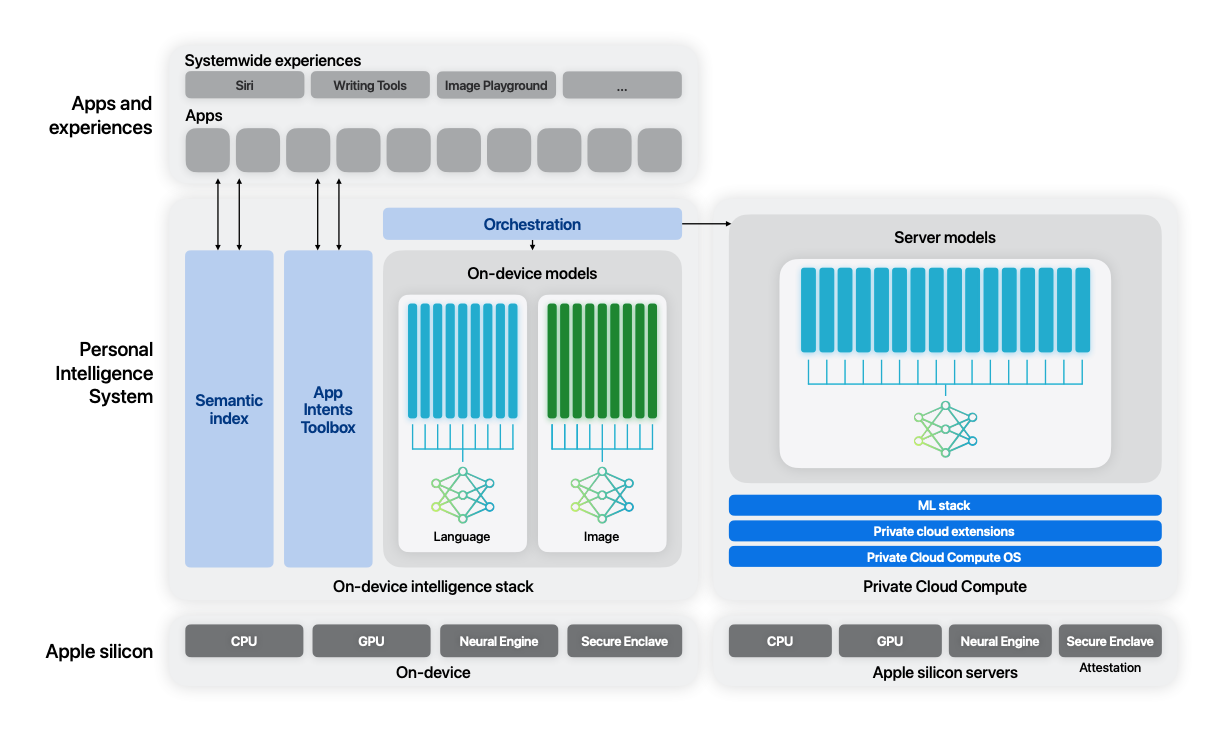

L’AI di Apple, secondo me, sarà:

- invisibile ma presente ovunque: non un’app, ma un layer distribuito.

- integrata in tutti i livelli di interazione: voce, testo, occhio, gesture.

- privata per design: non solo marketing, ma architettura.

- sicura e personale: ancorata al device, non alla nuvola.

- contestuale e adattiva: in grado di capire se sto lavorando, chattando, leggendo o cucinando.

Questa AI abiliterà un’esperienza di continuità autentica:

- mi sposto da iPhone ad Apple TV e il contenuto mi segue.

- inizio una nota su Mac, la finisco a voce su iPad.

- faccio una ricerca con lo sguardo, continuo con la voce.

- mentre scrivo una mail, l’AI capisce che sto rispondendo a un problema ricorrente e mi suggerisce un documento interno già condiviso.

- se sto preparando una presentazione e ho aperto le note di una call precedente, l’AI mi mostra i punti chiave e mi propone slide generate su misura.

- quando accedo all’auto, sa che ho una conference call tra 15 minuti e mi propone il collegamento via CarPlay.

- sto parlando con una persona e chiedo di salvare il numero di telefono e mentre me lo dice si attiva.

- ricevo un messaggio da un cliente, e senza cercare nulla mi propone le tre risposte più coerenti con il mio tono passato.

- mentre guardo un documento, capisce che sto preparando una riunione e compone in background una scaletta, collegando contenuti, date e allegati già usati.

- apro il calendario e mentre inserisco un appuntamento, l’AI nota un conflitto implicito (es. tempo di spostamento insufficiente) e propone alternative logistiche.

- se ascolto una conference call in cuffia, capisce che ho cambiato lingua e inizia la traduzione simultanea senza interruzioni.

E potrei continuare con cose , che in parte già facciamo, con diversi strumenti, con diverse app, ma in un posto, in modo sempre più naturale, integrato e non visibile.

Invece di una AI che si mostra, Apple costruirà una AI che si dissolve nell’esperienza. Che sa cosa fare, quando farlo e soprattutto quando non disturbare.

E mentre tutti cercano di farci credere che l’AI sia un oggetto, Apple studia come farla diventare un ambiente.

Tutti vogliono sapere cosa Apple dirà sull’AI. Io sto aspettando di vedere cosa ci farà fare.