Beyond Virtual: come lo Spatial Computing sta ridisegnando il futuro del gaming

Ieri ho partecipato all’Italian Gaming Expo a Roma con uno speech dal titolo “Beyond Virtual: Spatial Computing and XR for the Future of Gaming”. Un’occasione utile per mettere a fuoco un tema che seguo da tempo con passione e studio, e che ho affrontato anche nel mio libro Spatial Shift: la convergenza tra intelligenza artificiale, tecnologie immersive e nuovi ambienti digitali.

Questa volta ho voluto declinare quei concetti sul settore del gaming, che forse più di altri sta già vivendo una trasformazione profonda, non tanto nel linguaggio estetico o nella logica del gameplay, ma nel modo in cui esperienze, ambienti e contenuti si relazionano allo spazio fisico e alla nostra presenza nel mondo reale.

Il punto di partenza è semplice quanto radicale: stiamo entrando in una nuova fase del computing. Dopo l’epoca desktop, quella mobile e quella cloud, oggi siamo nell’alba di un’era spatial, dove l’interazione con i contenuti digitali si libera dallo schermo e si distribuisce nell’ambiente che ci circonda. Lo chiamiamo spatial computing, ed è molto più di un’estensione dell’AR o della VR. È un cambio di paradigma nel modo in cui il digitale “vive” nello spazio.

Spatial computing: dal dispositivo all’ambiente

In questa nuova fase non interagiamo più con il contenuto “guardando dentro” un device. Il contenuto si proietta fuori. Lo spazio intorno a noi diventa un canvas digitale su cui appaiono elementi immersivi, persistenti, personalizzati. Non è solo una questione di effetto wow: è una trasformazione sistemica del nostro rapporto con l’informazione, la narrazione e il gioco.

Come sottolinea Cathy Hackl, una delle voci più lucide su questi temi, “spatial computing isn’t about devices, it’s about context”. È il contesto che conta. È lì che si gioca la sfida: capire come, dove e quando interagiamo. E soprattutto: chi costruisce questi contesti?

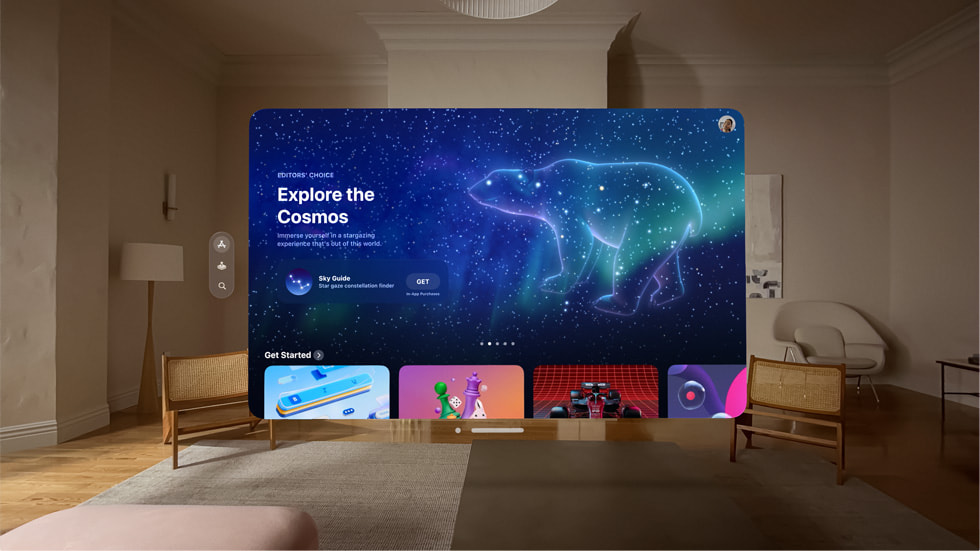

Nel gaming questa transizione è già visibile. Giochi come Pokémon GO hanno mostrato per primi la possibilità di costruire esperienze ludiche sovrapposte al mondo reale. Ma oggi siamo ben oltre: visori come Meta Quest 3 o Apple Vision Pro ci permettono di trasformare il salotto in uno spazio ibrido dove avatar, elementi digitali e oggetti fisici convivono. Il gioco non si svolge più in una finestra digitale, ma intorno a noi, in tempo reale, connesso a ciò che facciamo, vediamo e sentiamo.

Il gioco entra nel mondo reale

Questo shift ha due implicazioni molto forti per chi progetta e costruisce contenuti ludici.

La prima è che l’ambiente stesso diventa parte integrante dell’esperienza. Non parliamo più di livelli predefiniti da navigare con un controller, ma di spazi reali in cui ci si muove fisicamente e in cui ogni elemento – un muro, una sedia, una finestra – può diventare parte attiva della narrazione. L’ambiente non è più lo sfondo, è il gameplay.

La seconda è che il corpo torna ad essere centrale. Il corpo non come ostacolo, ma come interfaccia. Con la computer vision, l’eye tracking, il motion sensing e il feedback aptico, il giocatore non è più “fuori dal gioco” ma dentro, presente, immerso e co-autore dell’esperienza.

In questo scenario, il design cambia pelle. Non si tratta più di scrivere regole per un mondo chiuso, ma di orchestrare esperienze in ambienti aperti, dinamici, interattivi e spesso condivisi. Il confine tra gaming, fitness, socialità, formazione o comunicazione diventa sempre più sottile.

AI, generazione procedurale e ambienti intelligenti

Un’altra variabile che sta accelerando tutto questo è l’intelligenza artificiale.

Non è un’esagerazione dire che la convergenza tra AI e spatial computing sta ridisegnando le fondamenta stesse dell’intrattenimento.

L’AI generativa consente oggi di creare NPC autonomi e realistici, mondi generati dinamicamente, missioni che si adattano in tempo reale al comportamento del giocatore. Ma soprattutto, permette a ogni esperienza di essere personalizzata e situata. Un gioco spatial può cambiare non solo in base al tuo livello o alle tue scelte, ma in base al luogo in cui sei, all’ora del giorno, a chi hai intorno.

Stiamo passando da ambienti digitali “chiusi” a ecosistemi intelligenti in grado di leggere, interpretare e rispondere. La logica stessa della progettazione cambia: da una narrativa predefinita a una co-costruita, dove il giocatore entra in relazione attiva con il contesto. È un salto concettuale e tecnico, ma è anche una grande opportunità per re-immaginare il concetto stesso di gioco.

Il gaming come infrastruttura esperienziale

Molti considerano il gaming un sottoinsieme dell’intrattenimento. In realtà, oggi sta diventando sempre più una piattaforma culturale, un’infrastruttura esperienziale. Lo vediamo nei mondi persistenti di Fortnite o Roblox, dove i confini tra gioco, socialità, evento e commercio si fondono. Lo vediamo nella logica dei digital twin, nei training simulator in XR, nei giochi educativi in MR. Il linguaggio ludico sta diventando la grammatica con cui interpreteremo una parte crescente della realtà aumentata che abiteremo nei prossimi anni.

Il gioco non è più uno spazio-tempo separato. È un layer aggiuntivo che si sovrappone alla vita. Può accendersi durante una camminata in città, durante una sessione di allenamento, o mentre esploriamo un museo. Diventa strumento di coinvolgimento, apprendimento, relazione.

Opportunità e nuove domande

Tutto questo apre scenari enormi per chi sviluppa prodotti, contenuti e strategie in ambito gaming e tech. Si apre un nuovo mercato, con nuovi modelli di business e nuove filiere. Ma emergono anche domande nuove, profonde, che non possiamo ignorare.

Chi possiede lo spazio virtuale sovrapposto a quello fisico? Come si tutelano la privacy, i dati ambientali, i comportamenti biometrici raccolti dai dispositivi XR? Come si regolamenta l’accesso, la moderazione, la sicurezza in un gioco che si svolge nel mondo reale, tra persone vere?

Sono le domande che iniziano ad affiorare oggi, ma che saranno centrali domani, quando milioni di persone inizieranno ad abitare queste esperienze spatial ogni giorno.

Oltre il virtuale

Lo spatial computing non è una moda passeggera. È un cambio di fase.

E il gaming non è semplicemente uno dei primi settori a esserne toccato: è il motore culturale che può guidarne l’evoluzione.

Come ha detto Tim Sweeney, CEO di Epic Games:

“AR glasses will become the entertainment platform of the future, replacing smartphones, tablets, and maybe even TVs.”

Non è più questione di se, ma di quando.

E soprattutto, di come costruire esperienze che non si limitino a stupire, ma che abbiano valore, coerenza e impatto.

Per questo credo che oggi più che mai sia il momento di pensare oltre il virtuale – e iniziare a progettare quello che viene dopo.