Prompt-Chaining: tagliare (il prompt) l’elefante a pezzi e ragionare per passi

Negli ultimi mesi ho seguito e condiviso con attenzione il lavoro di Nicola Mattina, che attraverso l’implementazione del progetto #Serena (di cui vi parlerò ancora), sta esplorando in modo sperimentale continuo l’interazione uomo-macchina: il prompt chaining.

I suoi post, in particolare uno degli ultimi che riporto qui, mi hanno spinto a riflettere sul fatto che il prompt chaining non è solo una tecnica per “istruire meglio” l’AI, ma può diventare una vera e propria architettura cognitiva. Un modo per strutturare il pensiero delle (e con le) macchine, in modo simile a come strutturiamo il nostro.

Da questo spunto nascono le seguenti righe che condivido qui sotto, ad integrazione del lavoro di Nicola, ossia una breve riflessione sulle potenzialità del prompt chaining, in particolare nella progettazione di contenuti educativi, ma con uno sguardo più ampio su cosa può rappresentare per chi, come molti di noi, lavora con strumenti generativi in contesti strategici o formativi.

Prima di tutto cos’è il Prompt Chaining

In parole semplici, prompt chaining significa collegare insieme più prompt in sequenza, facendo sì che l’output di un prompt diventi l’input del successivo . Invece di chiedere a un modello linguistico di svolgere un compito complesso tutto in una volta, lo si scompone in passi più piccoli e gestibili, rendendo più efficiente l’elaborazione, l’accuratezza ed il consumo sottostante che viene impiegato per elaborare la richiesta.

Per capirci, come succederebbe nella relazione umana, invece di dire ad un copywriter “Scrivimi l’articolo sull’AI” creando la condizione per cui l’interlocutore deve decidere a cosa dare priorità, su quali argomenti soffermarsi e ottimizzare il tempo a disposizione, si chiede qualcosa di più specifico, più nel dettaglio, progressivamente sempre più in profondità, raffinando il concetto.

Ogni prompt nella catena dei prompt si concentra su un sotto-compito specifico, mantenendo il contesto e guidando il modello passo dopo passo . Questo processo iterativo permette all’AI di affrontare compiti complessi in modo più efficace, migliorando accuratezza e coerenza delle risposte .

“Eh, ma Chat è stupido…”

Quando mi sento dire “Eh ma Chat è stupido, mi risponde con testi banali“, spesso rispondo che è normale perchè cosicome esistono principi di LIFO, FIFO e via dicendo, nell’ai più che mai esiste anche il MIMO ossia Merd-In Merd-Out (o come direbbero i fighi Shit-in Shit Out).

Se chiediamo all’AI di scrivere un intero report in un solo prompt, otterremo con molta probabilità un risultato superficiale, disorganizzato o incoerente. Perché? Perché il modello deve fare tutto in una volta sola: strutturare, scrivere, sintetizzare, scegliere priorità, tono e contenuti, senza una guida chiara. È come chiedere a qualcuno di cucinare una cena gourmet mentre corre una maratona. Serve ordine, energia e tempo – ma se tutto viene concentrato in un colpo solo, il risultato ne risente.

Con il prompt chaining, invece, possiamo scomporre il compito in step successivi. Prima chiediamo un elenco dei punti chiave, poi sviluppiamo ciascun punto in un paragrafo, infine rivediamo e affiniamo il testo. Ogni fase prepara la successiva, mantenendo un filo logico chiaro. Questo approccio non solo aiuta l’IA a produrre contenuti migliori, ma ottimizza anche il modo in cui consuma le sue risorse.

Ogni interazione con un modello AI, infatti, utilizza dei token: piccole unità che rappresentano parole, punteggiatura e spazi. Ogni prompt e ogni risposta consumano token, e ogni modello ha un limite massimo oltre il quale inizia a “dimenticare” o a perdere contesto: è la cosiddetta finestra di contesto. Se proviamo a incastrare troppa roba in un solo prompt, superiamo questo limite e il modello rischia di produrre un risultato povero o scollegato.

Qui si nota una differenza concreta tra chi usa la versione Free di ChatGPT (basata su GPT-3.5, con un limite di circa 4.000 token, cioè poche pagine di testo complessivo) e chi ha attivato la versione Plus, che usa GPT-4-turbo, in grado di gestire fino a 128.000 token – l’equivalente di un libro intero. Con GPT-4, quindi, possiamo costruire catene di prompt molto più lunghe, mantenendo la coerenza del discorso e una memoria estesa.

È come viaggiare con un’auto che ha un serbatoio piccolo (GPT-3.5) o con una che può contenere molta più benzina (GPT-4): entrambe ti portano a destinazione, ma nel primo caso dovrai fermarti spesso e ridurre il carico, nel secondo puoi affrontare tragitti più lunghi, con meno compromessi e migliori prestazioni.

Oltre l’ingegneria dei prompt

Il prompt chaining non è solo un modo “furbo” di scrivere prompt, ma si avvicina a una forma di architettura cognitiva. In pratica stiamo progettando la struttura del ragionamento dell’IA. Come un architetto progetta l’organizzazione di un edificio, chi utilizza il prompt chaining progetta come l’IA suddivide e affronta un problema. Ricorda il modo in cui noi umani affrontiamo compiti complessi: li dividiamo in step, li risolviamo uno per uno, e infine uniamo tutto. Allo stesso modo, il chaining fa sì che il modello di AI “pensi ad alta voce” attraverso passaggi intermedi, mimando un processo cognitivo umano .

Non a caso, ricercatori e sviluppatori vedono queste catene di prompt come elementi di agenti AI più evoluti. In diversi studi e articoli si nota che aggiungere flussi di controllo interni come il prompt chaining ai modelli linguistici porta a una nuova generazione di “agenti” IA, capaci di ragionare e interagire in modo più strutturato . In altre parole, concatenare prompt è un modo per orchestrare la cognizione dell’AI: stiamo dando al modello un percorso da seguire, un po’ come una scaletta mentale. Questo approccio apre le porte a sistemi AI più affidabili e “pensanti”, anziché limitarsi a mere scatole nere che sputano fuori una risposta senza farci capire il come e il perché.

Scomporre i problemi per soluzioni migliori

“Perché spezzettare un compito aiuta l’AI a produrre risultati migliori?” mi chiedono spesso in aula. I motivi sono intuitivi. Innanzitutto, ogni parte del problema riceve attenzione dedicata: affrontando un passo alla volta, il modello può dedicare più risorse cognitive a ciascun aspetto, senza essere sopraffatto dalla complessità generale . Questo porta a risposte più complete e approfondite su ogni sotto-tema, migliorandone la qualità complessiva .

In secondo luogo, il prompt chaining aumenta la coerenza e il mantenimento del contesto: ogni prompt successivo eredita le informazioni dai precedenti, evitando che l’AI “dimentichi” dettagli importanti lungo il percorso . Questo è cruciale, ad esempio, quando si crea una narrazione o un progetto articolato, perché garantisce che tutte le parti “parlino la stessa lingua” e si integrino bene.

Un altro vantaggio è la maggiore trasparenza del ragionamento. Richiedendo all’AI di mostrare passo dopo passo il processo (ad esempio elencando ragionamenti o calcoli intermedi), diventa più facile per noi umani seguire il filo logico e capire come si è arrivati a una certa conclusione. Questa tracciabilità (tema che affronterò in modo dedicato in un altro post) non solo aumenta la fiducia nell’output — possiamo vedere perché l’AI suggerisce X invece di Y — ma ci consente anche di individuare eventuali errori logici in itinere.

Infatti, suddividendo il problema, possiamo correggere il tiro a metà strada se notiamo che l’AI sta deviando: il chaining facilita l’isolamento di quale passo ha generato un errore, semplificando interventi e debug. È lo stesso principio su cui si basano i nuovi modelli di AI avanzati, come GPT-4 o Claude Opus, che stanno iniziando a integrare forme esplicite di reasoning interno, strutturato in catene di pensiero (chain-of-thought reasoning), per spiegare le decisioni che prendono. Il prompt chaining è oggi uno strumento manuale per ottenere ciò che i modelli di domani inizieranno a fare da soli: pensare per passaggi visibili e controllabili (e quindi revisionabili).

Infine, questo approccio metodologico aiuta a mitigare i limiti pratici dei modelli. I modelli linguistici hanno una finestra di contesto limitata (una quantità massima di testo che possono gestire alla volta); fornire tutte le istruzioni in un unico prompt lungo può essere inefficace o impossibile. Con una catena di prompt, in sinstesi, si alimenta gradualmente l’informazione restando nei limiti, senza perdere il contesto e allo stesso tempo, si riduce il rischio di allucinazioni fuori tema, mantenendo il modello concentrato su un sub-compito alla volta e reintegrando il contesto ad ogni passo.

Praticamente in questo modo abbiamo una AI sempre “sul pezzo” e le facciamo evitare divagazioni fantasiose.

Progettare un corso con l’AI passo dopo passo

Per rendere concreto tutto questo, immaginiamo di utilizzare il prompt chaining per un compito manageriale comune: progettare un corso di formazione o creare contenuti didattici strutturati.

Invece di chiedere subito all’AI “Scrivi il programma dettagliato di un corso su X”, potremmo procedere per fasi:

-

Definire l’obiettivo e il pubblico: In un primo prompt, chiediamo al modello di delineare gli obiettivi formativi del corso X e di identificare il pubblico target (es. principianti, livello avanzato, ecc.). Questo stabilisce il contesto e la direzione generale.

-

Creare un elenco di moduli/lezioni: Con gli obiettivi chiari, un secondo prompt potrebbe chiedere una struttura a moduli o lezioni chiave del corso. L’AI proporrà, ad esempio, 5-10 moduli tematici in sequenza logica.

-

Dettagliare i contenuti di ciascun modulo: Per ogni modulo individuato, possiamo generare a catena un ulteriore prompt che ne chiede i dettagli: concetti da coprire, esempi pratici, esercitazioni o casi di studio da includere.

-

Sviluppare materiali o approfondimenti: Una volta approvata la struttura, ulteriori prompt possono concentrarsi sulla creazione di contenuti specifici – ad esempio, “Genera una dispensa introduttiva per il Modulo 1” o “Suggerisci 3 domande quiz per verificare l’apprendimento nel Modulo 2”. Così, gradualmente, si popola l’intero corso.

-

Revisione e rifinitura: Infine, si può usare un prompt conclusivo per fare un check generale, ad esempio “Rivedi il syllabus completo del corso e verifica che il linguaggio sia adatto a [pubblico target] e coerente in tutti i moduli”. Oppure chiedere un riepilogo executive da presentare al team.

Ad ogni passo, l’output dell’AI alimenta il passo successivo. Il risultato finale è molto più ricco e strutturato di quello ottenibile con un singolo prompt generico. Chi ha sperimentato questo approccio nota che “pensare in catene, anziché tentare il colpo grosso con un solo prompt di quelli da fanta-guru-brillante, ha segnato un punto di svolta e ha raggiunto un goal in modo più preciso” . In altre parole, il prompt chaining aiuta l’AI a seguire un filo logico simile a come lo seguirebbe un istruttore umano, con il vantaggio di poter generare rapidamente contenuti per ogni punto del programma.

Questo approccio non è utile solo per corsi ovviamete: qualunque progetto che richieda output complessi e ben organizzati (dai piani strategici, alla stesura di rapporti articolati, fino alla ricerca di mercato) può trarre beneficio da una suddivisione in prompt sequenziali. Il bello è che il controllo rimane all’utente umano: possiamo intervenire tra uno step e l’altro, aggiustare il tiro o inserire input aggiuntivi, guidando l’IA come faremmo con un collaboratore umano.

Ma non è lo stesso che chiedere “approfondisci”?

Una domanda legittima è: “Ma non è la stessa cosa di quando scrivo un prompt generico e poi chiedo all’AI di approfondire o usare Deep Research”. La risposta è no, non è la stessa cosa — né per approccio, né per controllo, né per qualità del ragionamento.

Quando chiediamo a un’AI “approfondisci questo punto” o “fammi un elenco di motivi”, stiamo delegando completamente al modello la scelta di cosa approfondire, in che ordine e con quale criterio. L’AI fa del suo meglio in base al contesto ricevuto, ma decide lei come interpretare la richiesta e cosa restituire. È un approccio reattivo, utile ma passivo.

Nel prompt chaining, invece, è l’utente a guidare attivamente e intenzionalmente il processo: decide in anticipo i passi, li struttura in modo progressivo e ne controlla coerenza e profondità. Ogni sotto-domanda è pensata come parte di un flusso, e l’output di ciascun passaggio è validato prima di passare al successivo. In altre parole, il chaining costruisce un ragionamento architettato, mentre l’approccio a “prompt singolo + follow-up” si limita a inseguire l’output, senza reale regia.

Questo è il punto di contatto e insieme di differenziazione rispetto ai nuovi modelli con reasoning interno automatizzato, che iniziano a generare da soli le domande intermedie, gli step di verifica o gli scratchpad (una specie di taccuino mentale in cui “annotano” i passaggi logici). In quel caso l’AI sta simulando un flusso cognitivo autonomo, ma resta comunque opaco all’utente se non viene esplicitato. Il prompt chaining, invece, porta alla luce il processo, lo rende trasparente, ispezionabile e — cosa non da poco — intervenibile.

Chiedere “approfondisci” è come affidare un tema all’AI e sperare che interpreti bene la traccia. Il prompt chaining è come costruire insieme all’AI una scaletta, definire ogni paragrafo e correggere lungo il percorso. È la differenza tra reattività e progettualità.

Strumenti e casi emergenti

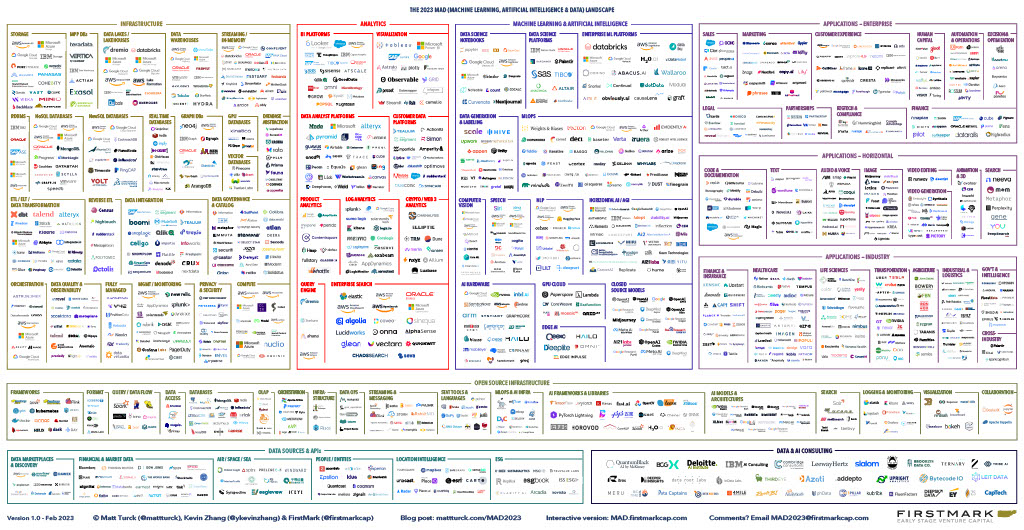

Il concetto di prompt chaining si è diffuso così rapidamente che sono nati strumenti e framework dedicati. La libreria open-source LangChain ne è un esempio e permette agli sviluppatori di creare facilmente pipeline di prompt collegate, integrando anche memoria esterna e chiamate a strumenti, per costruire agenti AI sofisticati. Esistono anche altre piattaforme più user friendly come Voiceflow e altre soluzioni no-code che offrono interfacce visuali per orchestrare conversazioni multi-turno e flussi di prompt, così che anche chi non programma possa progettare l’interazione step-by-step.

All’inizio del boom di ChatGPT, alcuni esperimenti come AutoGPT hanno mostrato il potenziale di un’AI che autonomamente insegue un obiettivo tramite una sequenza di azioni e sottocompiti. In pratica AutoGPT crea i propri prompt in catena per raggiungere un fine assegnato, simulando un agente quasi “autonomo”. Questi esempi, seppur embrionali, dimostrano la potenza dell’idea: spezzando i problemi e pianificando i passi, l’AI può affrontare anche compiti molto articolati. Non sorprende che aziende come OpenAI, Microsoft e altri stiano investendo in queste direzioni, integrando meccanismi di chaining e ragionamento nei loro sistemi .

Stiamo assistendo ai primi passi di una nuova orchestrazione cognitiva, dove l’intelligenza artificiale non è più vincolata a rispondere istantaneamente a un singolo prompt, ma può elaborare un piano d’azione interno prima di fornire la soluzione. Questo è un cambio di prospettiva entusiasmante, perché avvicina l’operato dell’AI a un processo decisionale più umano e strategico.

Perché oggi tutti dovrebbero interessarsene?

Da un punto di vista manageriale e business, il prompt chaining offre risultati più affidabili e raffinati dalle AI, il che può tradursi in decisioni migliori e contenuti di qualità superiore. Ad esempio, nei team di L&D (Learning & Development) o di content marketing, utilizzare l’AI in modalità “a catena” permette di sviluppare corsi, tutorial, documentazione o white paper in maniera organizzata e coerente, riducendo il lavoro di editing successivo. Si passa da un’AI percepita come scatola magica imprevedibile a un’AI vista come collaboratore logico: un assistente che segue un processo, su cui possiamo intervenire in itinere. Ciò aumenta la fiducia nell’utilizzo e ne amplifica il valore nell’operatività quotidiana.

La trasparenza fornita dai passi intermedi è preziosa per la governance dell’AI in azienda: poter spiegare come una macchina ha elaborato un output (grazie ai ragionamenti esposti nella chain) può essere fondamentale per conformità, auditing o semplicemente per convincere gli stakeholder dell’affidabilità di una soluzione AI. In ambito educativo o formativo, come già notato, l’approccio step-by-step “alla insegnante” migliora l’attenzione ai dettagli e l’efficacia pedagogica . Insomma, il prompt chaining unisce il pensiero analitico umano con la velocità di calcolo dell’IA, offrendo il meglio di entrambi i mondi.

Verso un futuro di AI più “umana”

Il prompt chaining rappresenta uno step avanti: da semplici richieste isolate a una collaborazione più strutturata uomo-macchina. Questa metodologia deve farci notare che l’AI può (e deve) essere guidata a pensare per passi, e che spesso la chiave per risultati straordinari sta nel porre le giuste domande nell’ordine giusto. È un campo in rapido sviluppo, con implicazioni che vanno oltre la tecnologia e toccano l’organizzazione del lavoro e la progettazione di conoscenza.