Mentoring, AI e Return of Trust (ROT): dall’ROI alle relazioni nell’era digitale

Ieri sera, 7 maggio 2025, ho avuto il piacere di partecipare, grazie all’invito di Ruggero Parrotto e di iKairos, alla tavola rotonda “Intelligenza Artificiale, Mentoring ed Economia Sociale”, all’interno del ciclo Il mondo che vorrei.

Un momento di confronto aperto e stimolante, che ha messo insieme visioni ed esperienze diverse, dalla filosofia alla cybersecurity, dalla pubblica amministrazione al mondo dell’innovazione , per affrontare uno dei nodi più rilevanti del nostro tempo: cosa accade quando l’intelligenza artificiale incontra le persone e le relazioni?

Ho condiviso il tavolo con Mario De Caro, Concettina Cassa, Gerardo Costabile, Emanuele Gentili, Pietro Pacini e con altri contributi trasversali, in un dialogo che si è mosso fin da subito su una domanda fondamentale:

L’AI può diventare davvero uno strumento accessibile, equo e umano-centrico? E soprattutto, come si allena la fiducia in un contesto sempre più mediato da sistemi intelligenti?

Proprio il tema della fiducia è stato il filo conduttore della mia riflessione.

In un passaggio del mio intervento ho affermato che «l’AI è al tempo stesso catalizzatore e stress-test della fiducia: smonta certezze consolidate e ci obbliga a ridefinire le grammatiche delle nostre relazioni, prima tra persone e tecnologia, poi tra persone stesse». Ed è da questa consapevolezza che nasce il concetto che ho proposto come chiave di lettura per leggere il cambiamento in atto: il ROT – Return on Trust.

ROT – Return on Trust: la fiducia come nuovo valore misurabile

Il ROT è un acronimo che ho introdotto per sottolineare un punto che ritengo cruciale: se il ROI (Return on Investment) è da sempre la metrica dominante per valutare progetti e strategie, e ancora più oggi quando si parla di AI, oggi serve forse affiancargli un nuovo indicatore, capace di misurare qualcosa di meno tangibile ma altrettanto determinante: la fiducia generata.

Ogni nuova tecnologia, ogni riorganizzazione interna, ogni scelta manageriale ha impatto sulla fiducia.

Fiducia tra colleghi, tra leader e team, tra azienda e clienti, tra esseri umani e macchine. E se questa fiducia viene meno, se non viene coltivata, progettata, mantenuta, anche l’innovazione più performante rischia di fallire nel medio periodo. Al contrario, un ambiente in cui la fiducia circola e cresce è un contesto dove le persone collaborano meglio, si sentono ascoltate, imparano di più e innovano con maggiore libertà.

Le ricerche lo confermano. In aziende ad alto tasso di fiducia si registrano, rispetto a quelle a bassa fiducia, il 74% in meno di stress, il 106% in più di energia, il 50% in più di produttività, il 76% in più di engagement e molti altri valori incredibili.

Numeri che parlano chiaro.

E che ci dicono una cosa semplice: la fiducia è un moltiplicatore di valore. Il ROT, quindi, non è solo una provocazione lessicale che ho portato ma un tema centrale. È una metrica da costruire, un approccio per ridare centralità alla qualità delle relazioni nei processi di innovazione.

AI gentile & Mentoring inclusivo

Nel mio intervento ho portato una riflessione sul tema dell’AI gentile e del mentoring come leva per l’inclusione. L’intelligenza artificiale, se progettata con cura, può diventare uno strumento che affianca, e non sostituisce, il ruolo del mentore. Ho usato un’espressione a cui tengo molto

“l’AI non sostituirà il mentore, ma può diventarne la cassetta degli attrezzi”

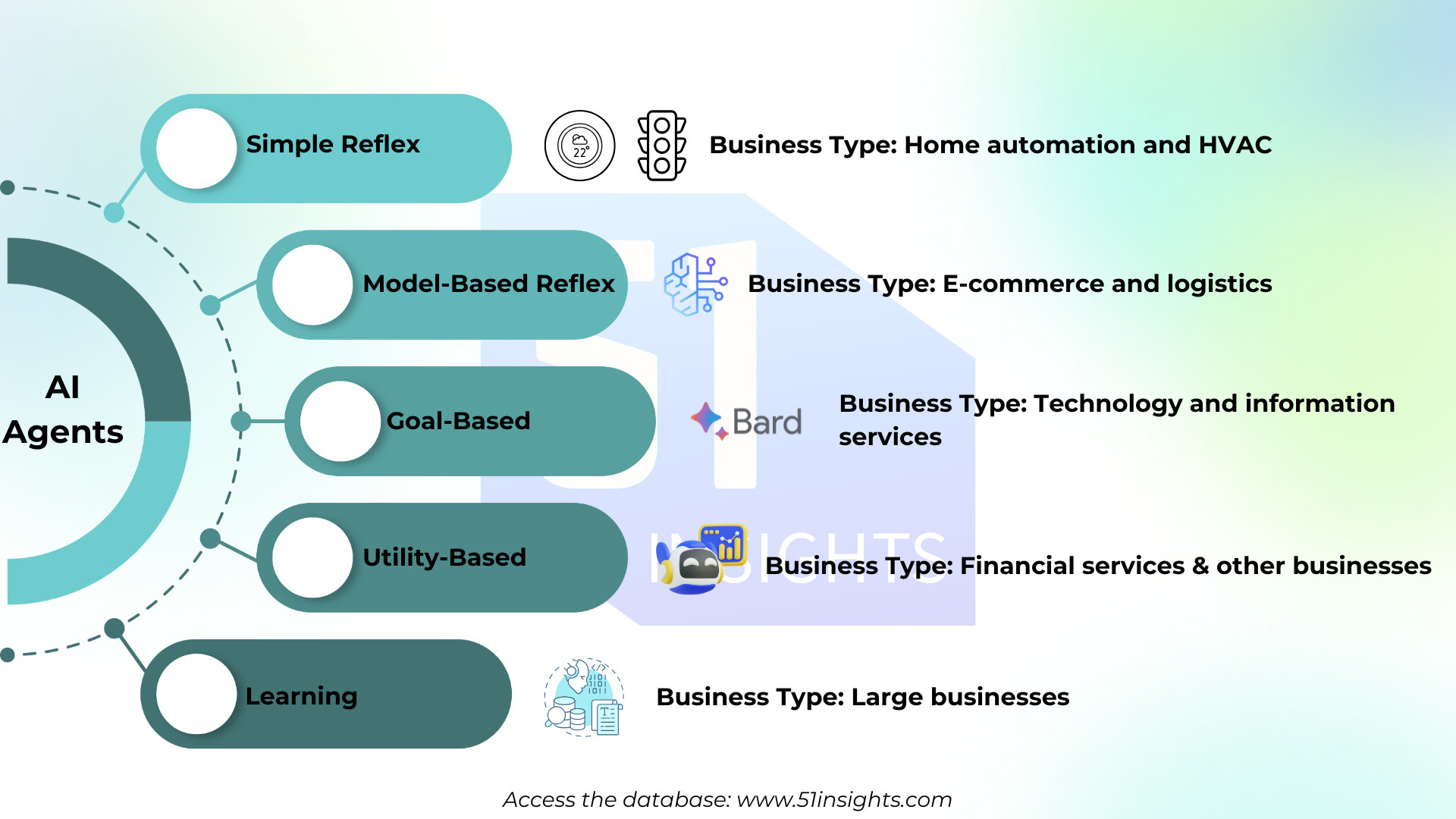

Pensiamo a un’AI in grado di supportare percorsi formativi personalizzati, rispondere a domande semplici, suggerire materiali su misura, liberando così tempo prezioso per il mentore umano. Il tempo “ritrovato”, abilitato dal delegare agli agenti AI azioni ripetitive, può essere dedicato a ciò che fa davvero la differenza: ascolto, orientamento, accompagnamento emotivo.

È questo lo “spazio relazionale” che l’AI può contribuire ad allargare, rendendo il mentoring più accessibile, scalabile e inclusivo, ma senza snaturarne l’anima profondamente umana.

Il mentoring, se integrato con strumenti digitali pensati con empatia e trasparenza, può guidare l’adozione dell’AI nelle organizzazioni. Può aiutare chi è meno esperto a comprendere non solo come usare questi strumenti, ma soprattutto perché. E può farlo con una pedagogia gentile, che smonta paure, costruisce competenze e restituisce alle persone il ruolo di protagonisti.

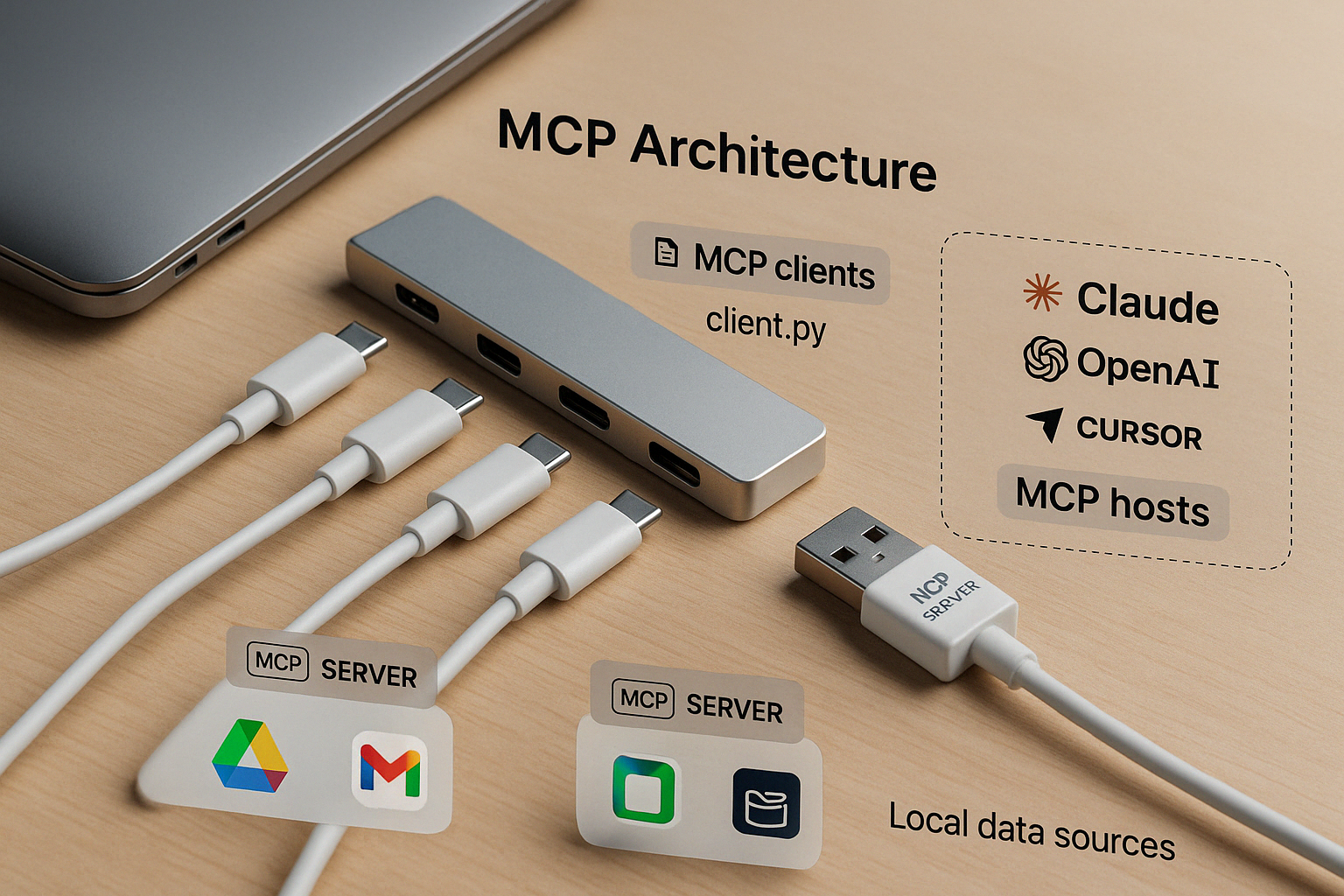

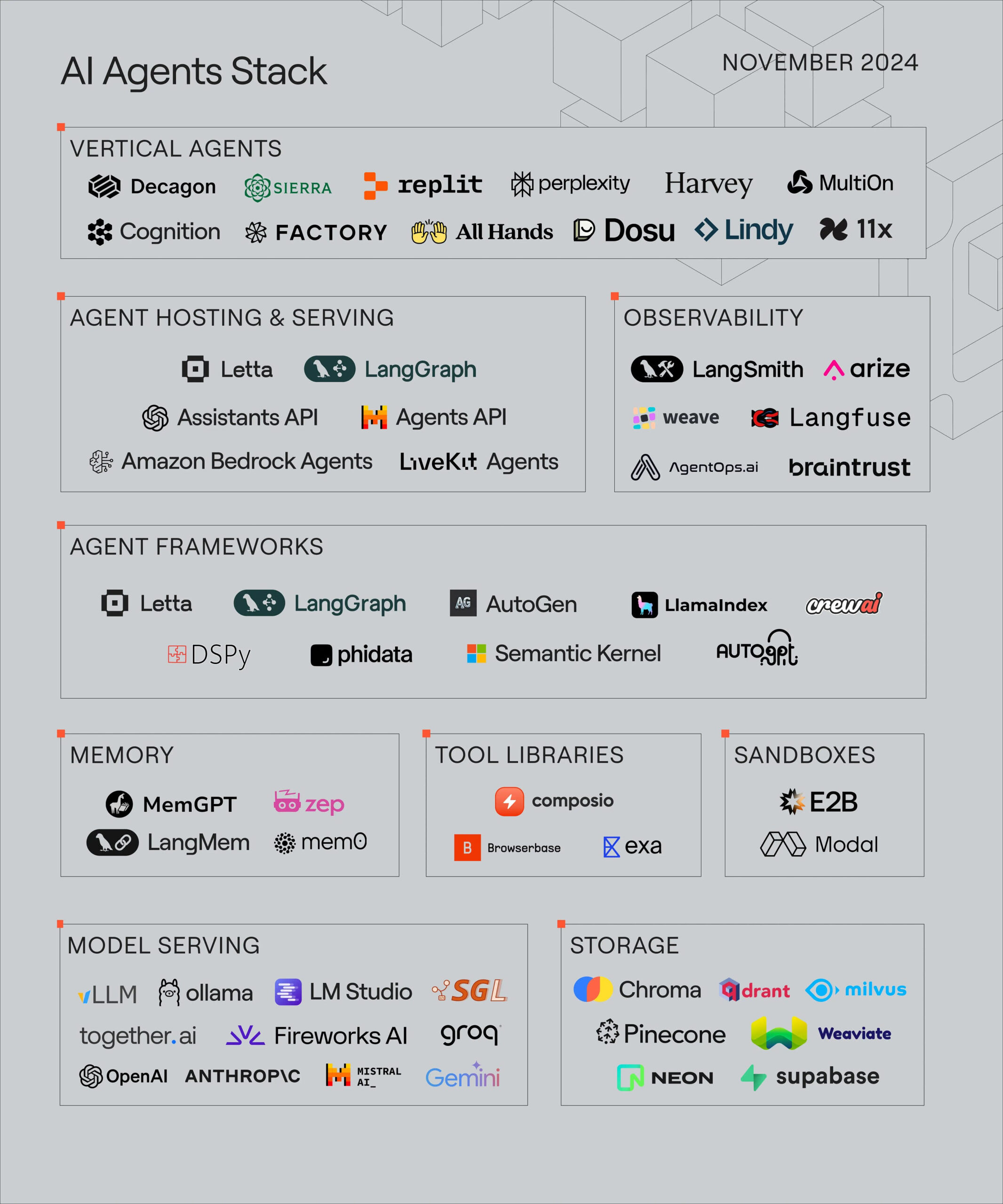

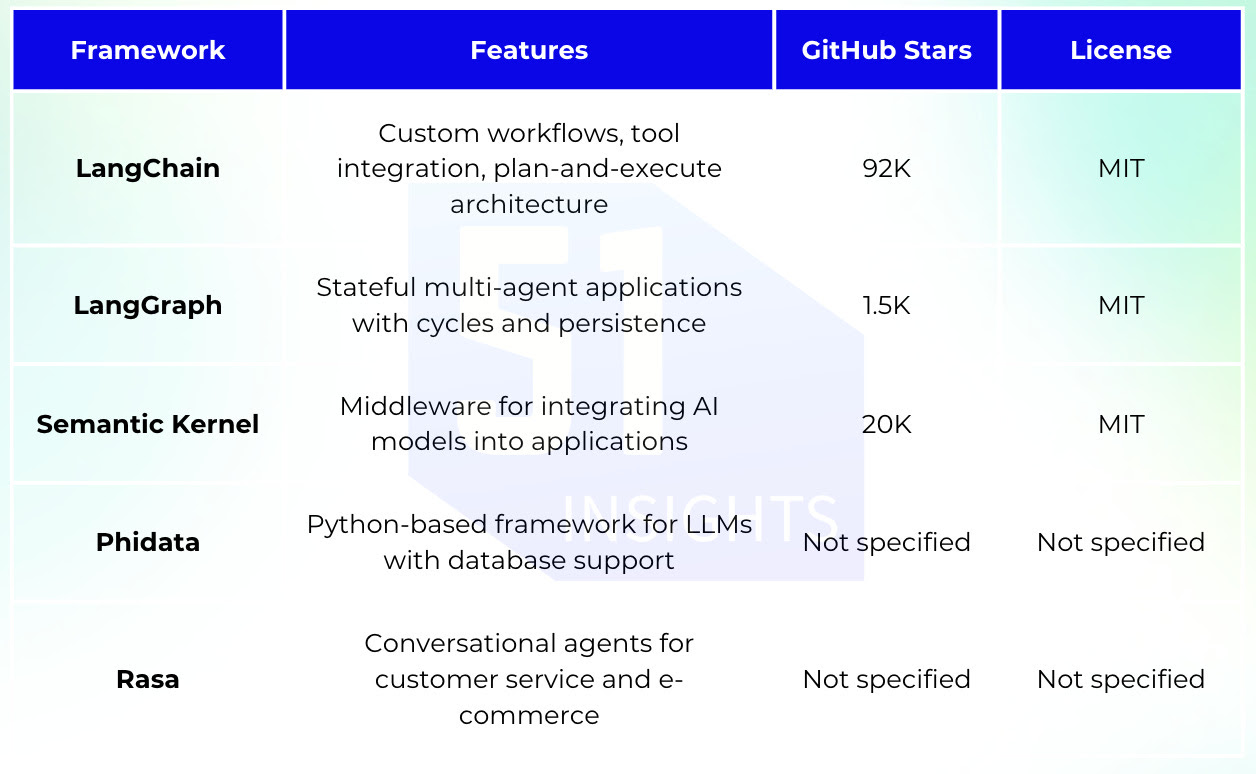

Verso l’organizzazione aumentata

Un altro passaggio chiave che ho trattato è stato quello dell’organizzazione aumentata, tema che da un po’ di tempo tratto. Ho voluto introdurre questo concetto per descrivere un nuovo modello organizzativo in cui persone e agenti AI collaborano nella definizione e nell’esecuzione dei processi, ma soprattutto ho parlato di organizzazioni che nei prossimi anni si troveranno a rivedere completamente l’organizzazione e l’organigramma integrando umani e macchine.

Ci troviamo già immersi in un contesto in cui l’AI prende decisioni operative, gestisce task, propone soluzioni. Questo impone un cambiamento di paradigma: non possiamo più immaginare l’AI come uno strumento esterno, ma come parte integrante dei team. Tre concetti chiave che ho portato alla discussione:

-

Competenze ibride, dove la capacità tecnica si unisce a pensiero critico, empatia e lettura del contesto.

-

Ruoli fluidi, perché con l’automazione cambiano le attività e serve maggiore adattabilità.

-

Leadership diffusa, dove ogni membro del team può contribuire, supportato da insight e dati intelligenti.

Ho richiamato in questo contesto alcuni principi del libro “L’etica hacker” (2001) di Pekka Himanen: passione, apertura, condivisione del sapere, tensione al miglioramento continuo. Una cultura che può ispirare i team aumentati, rendendoli non solo efficienti ma anche creativi e resilienti.

Naturalmente, tutto questo apre anche interrogativi e ho citato un libro che a me ha compito molto: Helga Nowotny, in Le macchine di Dio, mette in guardia dall’effetto oracolo: quando l’AI diventa troppo autorevole, c’è il rischio che le persone si appiattiscano sulle sue risposte e smettano di interrogarsi. Ecco perché serve un equilibrio continuo tra automazione e arbitrio umano, tra dati e valori, tra velocità ed empatia.

Mentoring come cerniera tra strategia e talento

In un mondo che cambia così velocemente, il mentoring può fare da cerniera tra strategia e talento. Permette di tradurre la visione dell’organizzazione in esperienze concrete di crescita, e al tempo stesso consente alle persone di influenzare la strategia portando idee, energie, domande.

Il mentoring non è solo trasferimento di competenze. È anche (e forse soprattutto) trasmissione di fiducia, di valori, di visione. È il luogo dove si può sbagliare, dove si può imparare, dove si costruisce senso. E questo è il terreno ideale per far maturare il ROT.

ROI + ROT: ripensare le metriche della trasformazione

Ttorno alla frase che ha guidato tutto il mio intervento e che, spero, continui a stimolare riflessioni anche oltre questo evento:

“Nell’era dell’AI, invece di pensare solo al ROI, impariamo a misurare anche il Return on Trust.”

Perché la vera trasformazione non si misura solo in efficienza, ma nella qualità delle relazioni che lascia, nella fiducia che costruisce, nella capacità di rigenerare apprendimento e collaborazione nel tempo.

Ringrazio ancora Ruggero, l’associazione iKairos, i relatori e tutte le persone che hanno partecipato. È stato un confronto aperto, utile, e soprattutto necessario. Perché è da qui, da queste conversazioni, che passa la possibilità concreta di costruire un futuro in cui l’intelligenza, anche quella artificiale, sia davvero un bene comune.

Sul tema del Rot ci tornerò con un approfondimento sulla misurazione e come implementarlo.