L’AI non è quello che pensi – 50 domande frequenti e risposte serie ma semplici sull’Intelligenza Artificiale

Sarà che quando si pubblica qualcosa, si è felici, ma oggi lo sono un po’ di più. Oggi ho (auto) pubblicato un nuovo lavoro, una piccola novità che, in un certo senso, è il risultato di anni di dialoghi, discussioni (accese) e scambi di opinioni su un tema che continua ad affascinarmi e sfidarmi: l’intelligenza artificiale. Sono contento di annunciare la pubblicazione del mio ultimo e-book su Amazon, “L’AI non è quello che pensi – 50 domande frequenti e risposte serie ma semplici sull’Intelligenza Artificiale” – una raccolta strutturata in 50 domande frequenti e provocatorie che tentano di rispondere ai dubbi, alle curiosità e agli equivoci che ruotano intorno all’AI.

Come nasce questo libro?

La genesi del libro è un mix di casualità e intenzione: da anni, durante eventi, lezioni, conversazioni e persino cene con amici, ho accumulato domande – alcune tecniche, altre curiose, e altre ancora del tutto inaspettate. In meno di sette giorni, dopo uno spunto di amici discutendo per l’ennesima volta di questi temi, e grazie anche al supporto di strumenti di AI come ChatGPT, Perplexity, Claude e DALL-E, ho raccolto e organizzato tutte le risposte in un formato accessibile. Mi sono reso conto che la struttura a domande e risposte è perfetta per chi cerca di orientarsi nel mondo dell’AI senza voler (o dover) diventare un esperto.

A chi è rivolto?

Il libro è pensato per chiunque: dal curioso che vuole saperne di più, allo scettico convinto che l’AI sia solo un’altra moda passeggera, fino a chi, già nel settore, cerca uno sguardo nuovo, senza tecnicismi eccessivi ma con un approccio puntuale. Non troverete un manuale tecnico, ma una guida che invita a riflettere, a sfatare miti e a scoprire aspetti meno noti dell’AI.

Macro temi trattati

Il cuore del libro esplora temi attuali e spesso controversi:

- Definizioni e Fondamenti: Cosa intendiamo per AI? Qual è il rapporto tra AI, machine learning e deep learning?

- Miti e Percezioni Sbagliate: L’AI è davvero una minaccia per l’umanità o uno strumento di supporto?

- Impatto sul Lavoro e sulle Professioni: Come cambierà il mercato del lavoro con l’avanzare dell’AI?

- Etica, Privacy e Sicurezza: Come gestire il lato etico di un’intelligenza artificiale in continua evoluzione?

- Creatività e Pensiero Critico: L’AI potrà mai essere creativa o comprenderà mai le emozioni umane?

- Fantascienza e Futuro: Un gemello digitale potrebbe interagire per noi in futuro? E cosa significherebbe questo per il ricordo e il legame con chi non c’è più?

Un lancio speciale

Per i prossimi giorni, il libro sarà scaricabile gratuitamente su Amazon, e successivamente sarà disponibile a 4,99 euro. Sto anche valutando la possibilità di una versione cartacea per chi, come me, preferisce ancora avere qualcosa di fisico da sfogliare.

Un ringraziamento speciale

Non posso concludere senza ringraziare chi ha reso questo progetto possibile. Alla mia famiglia, che ha sempre pazientemente sopportato le mie discussioni infinite sull’AI, agli amici con cui ho condiviso idee e battute (Roberto, Andrea, Angelo, Stefano, Fabrizio, Alessandro), e a tutti coloro che continuano a farmi domande e stimolare il confronto. Un ringraziamento va anche agli scettici e a tutti i curiosi, perché senza di voi queste 50 domande non avrebbero mai trovato una risposta.

Spero che questo libro possa offrirvi qualche spunto nuovo e, chissà, magari anche ispirarvi a fare nuove domande. Buona lettura! Qui per prenderlo in eBook

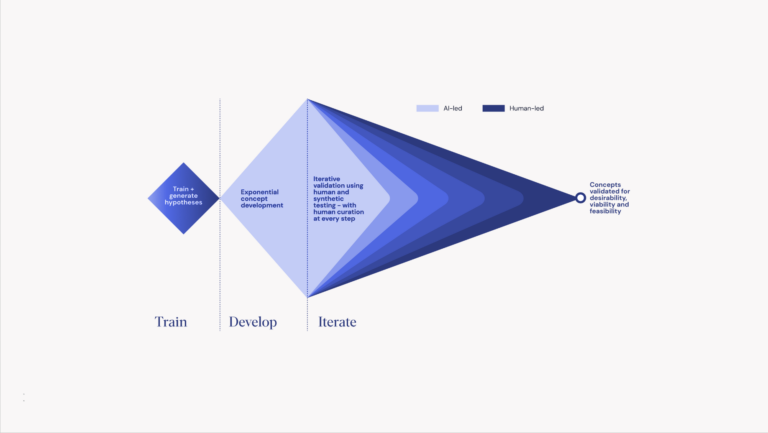

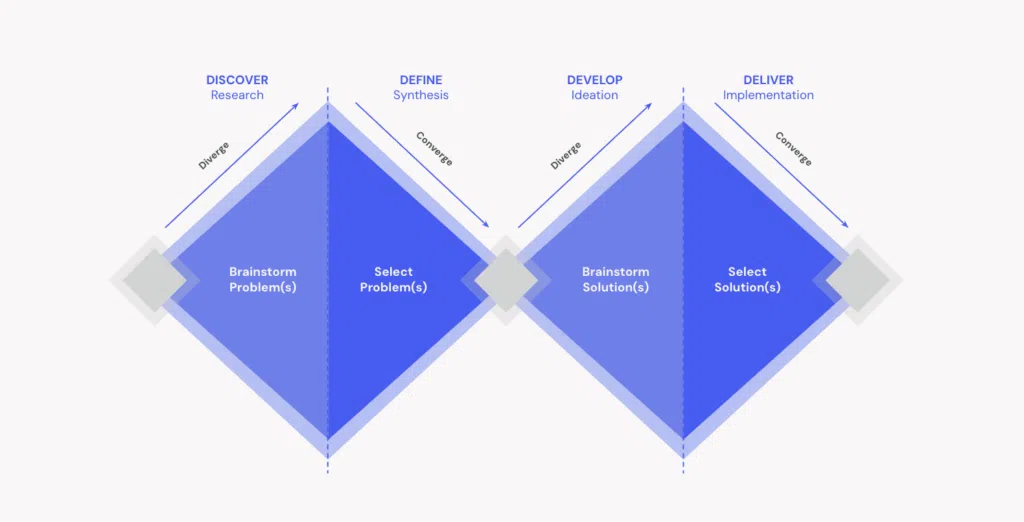

La sua forza risiede nella semplicità e nella struttura, che hanno guidato migliaia di individui e team globalmente, orientando investimenti miliardari. Tuttavia, l’emergere dell’innovazione guidata dall’intelligenza artificiale sta mettendo in discussione la sua rilevanza. Nato in un’epoca in cui i progetti erano limitati dalla quantità di Post-It su un muro e dalla capacità di elaborazione del cervello umano, il Double Diamond si appoggiava a strumenti come PowerPoint, Excel e Photoshop, lontani dalle potenzialità dell’odierna data science e GenAI.

La sua forza risiede nella semplicità e nella struttura, che hanno guidato migliaia di individui e team globalmente, orientando investimenti miliardari. Tuttavia, l’emergere dell’innovazione guidata dall’intelligenza artificiale sta mettendo in discussione la sua rilevanza. Nato in un’epoca in cui i progetti erano limitati dalla quantità di Post-It su un muro e dalla capacità di elaborazione del cervello umano, il Double Diamond si appoggiava a strumenti come PowerPoint, Excel e Photoshop, lontani dalle potenzialità dell’odierna data science e GenAI.