Innovation Shockwave Curve: dalla disruption all’impatto dell’AI

Che l’innovazione sia il motore della crescita economica e della competitività aziendale e della società non credo ci sia alcun dubbio e non dovrebbe esser, soprattutto l’evento pandemico vissuto, nemmeno necessario doverlo sottolineare.

Malgrado oggi sia noto che siamo entrati nel pieno dell’era della convergenza tecnologica e dell’accelerazione derivante dall’AI e seppur dovrebbe esserci maggiore consapevolezza della necessità di un approccio al cambiamento, su questo tema molti hanno ancora poca propensione e dirottano ancora pochi investimenti.

Nel corso degli ultimi decenni, abbiamo assistito a diverse fasi dell’innovazione, ognuna caratterizzata da modelli di diffusione e adozione tecnologica, caratterizzate da diversi fattori, culturali, sociali, economici e tecnologici.

L’evoluzione, la propagazione e l’impatto delle innovazioni digitali sul mercato hanno avuto andamenti e dinamiche differenti e la loro rappresentazione grafica ha dimostrato diverse curve ed effetti differenti negli anni, con ripercussioni ed effetti con manifestazioni in tempi, frequenze e volumi crescenti

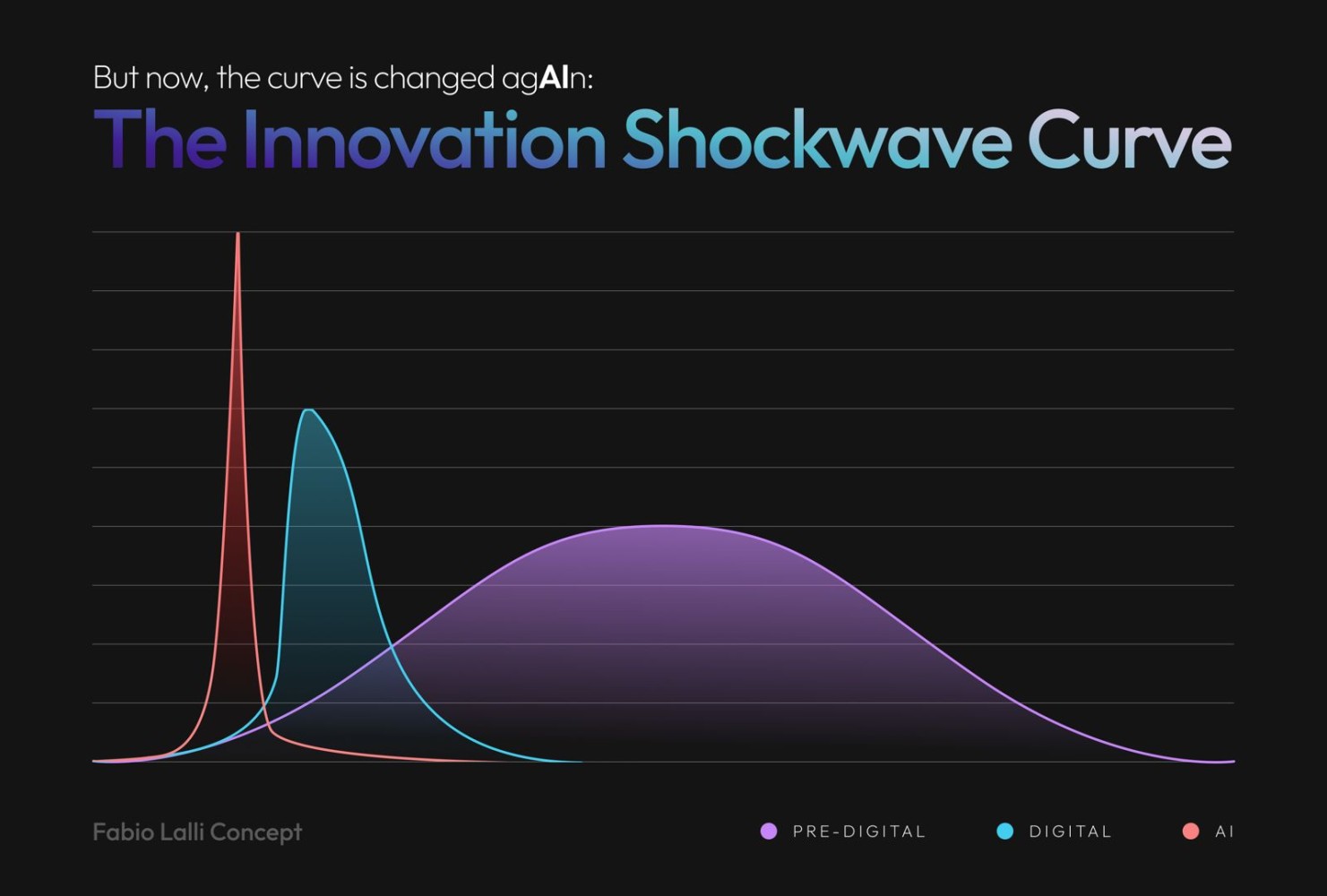

Partendo da modelli noti a distribuzione gaussiana, passando per la curva a pinna di squalo (quella della big bang disruption) definita qualche anno fa da Larry Downes e Paul Nunes, stiamo arrivando ad oggi, una fase in cui la maturità di diverse tecnologie e l’arrivo simultaneo dell’AI, sta creando una nuova fase, e quindi un nuovo potenziale impatto, che ho definito la fase della Innovation Shockwave Curve.

Ho buttato giù due righe di riflessioni sul tema, liberi di commentare, integrare, discutere e “distruggere” pensieri e riflessioni … in modo costruttivo.

La curva gaussiana dell’Innovazione

In un’era pre-digitale, le innovazioni tecnologiche erano limitate e richiedevano tempi di sviluppo molto lunghi. Le risorse per la ricerca e lo sviluppo erano meno accessibili e concentrate in poche grandi aziende o istituti di ricerca. La diffusione delle innovazioni avveniva principalmente attraverso mezzi di comunicazione tradizionali e il passaparola, che era un processo lento.

La curva di diffusione dell’innovazione, formalmente conosciuta come “diffusione dell’innovazione”, è stata introdotta da Everett M. Rogers nel 1962 nel suo libro “Diffusion of Innovations“. Questa curva, rappresentata come una distribuzione normale o gaussiana, illustra come le nuove idee e tecnologie vengono adottate nel tempo.

Rogers ha progettato questa curva per spiegare il processo attraverso il quale un’innovazione viene comunicata nel tempo tra i partecipanti a un sistema sociale. La curva si divide in cinque segmenti principali di adottanti: Innovatori, Early Adopters, Early Majority, Late Majority e Laggards. Ogni segmento rappresenta un gruppo distinto di persone che adottano l’innovazione in momenti diversi, a seconda della loro propensione al rischio e all’accettazione delle novità, oltre a fattori economico sociali.

Gli Innovatori, che costituiscono il 2.5% della popolazione, sono i primi a sperimentare nuove tecnologie. Sono seguiti dagli Early Adopters (13.5%), considerati leader d’opinione e primi costruttori della fiducia verso il mercato, e dall’Early Majority (34%), che adotta l’innovazione dopo un periodo di osservazione. La Late Majority (34%) è più scettica e adotta solo dopo che la maggior parte della società ha già accettato l’innovazione. Infine, i Laggards (16%) sono gli ultimi ad adottare, spesso solo quando diventa inevitabile. Questi ultimi due, per un tema di resistenza al cambiamento, adottavano le innovazioni solo dopo ampie prove di successo e la diffusione tra le masse.

Un punto cruciale nella curva di diffusione dell’innovazione è il Tipping Point (punto di non ritorno, coniato da Malcolm Gladwell nel suo libro del 2000, “The Tipping Point: How Little Things Can Make a Big Difference“). Questo punto rappresenta il momento in cui un’innovazione passa dall’essere adottata solo dai primi utenti (Innovatori ed Early Adopters) a diventare accettata dalla maggioranza del mercato (Early Majority). È il punto di svolta in cui l’adozione dell’innovazione diventa autoalimentante e inizia a diffondersi rapidamente attraverso il resto della popolazione.

Il Tipping Point è fondamentale perché segna il passaggio dalla fase iniziale di adozione, che richiede sforzi significativi di promozione e persuasione, a una fase di crescita accelerata dove l’innovazione guadagna trazione grazie al passaparola e alla crescente accettazione sociale. Raggiungere questo punto è spesso l’obiettivo principale delle strategie di marketing e lancio di nuovi prodotti, poiché una volta superato, l’innovazione tende a diffondersi più facilmente e rapidamente.

La curva di Rogers non fornisce solo una comprensione del comportamento di adozione, ma offre anche preziose indicazioni strategiche per le aziende. Comprendere la distribuzione degli adottanti e il significato del Tipping Point può aiutare a pianificare l’introduzione di nuovi prodotti e a sviluppare strategie di marketing mirate per ciascun segmento.

La Curva a Pinna di Squalo o curva della Big Bang Disruption

La curva della disruption è un concetto che ha preso forma nel 2014 grazie al lavoro di Larry Downes e Paul Nunes nel loro libro “Big Bang Disruption: Strategy in the Age of Devastating Innovation“. Questo modello è nato dall’osservazione dei cambiamenti rapidi e radicali che le tecnologie digitali stavano causando nei mercati esistenti. Downes e Nunes hanno studiato come l’avvento di tecnologie come il mobile, internet e i social media stavano trasformando interi settori economici, producendo innovazioni che non seguivano il tradizionale modello di adozione graduale delineato da Everett Rogers.

Il modello di Downes e Nunes articola la disruption in quattro fasi distinte. La prima fase, “Singularity“, è caratterizzata da numerosi esperimenti falliti che preannunciano l’arrivo di un cambiamento significativo. Nella fase del “Big Bang“, gli utenti abbandonano rapidamente i vecchi prodotti in favore di quelli nuovi. Segue la fase del “Big Crunch“, dove i disruptors subiscono un’implosione rapida e l’innovazione diventa incrementale. Infine, nella fase di “Entropy“, l’industria attraversa un declino terminale, preparando il terreno per l’ingresso di nuovi disruptors.

La curva della disruption si distingue nettamente dalla curva di diffusione dell’innovazione di Rogers, introdotta nel 1962. Mentre la curva di Rogers è rappresentata come una distribuzione normale (gaussiana), con una diffusione lenta e graduale delle innovazioni attraverso Innovatori, Early Adopters, Early Majority, Late Majority e Laggards, la curva della disruption è caratterizzata da una rapida ascesa, un picco acuto e un altrettanto rapido declino. Questo modello assomiglia a una pinna di squalo, riflettendo la velocità e l’intensità con cui le innovazioni digitali possono devastare i mercati esistenti.

Se nella curva di Rogers, come ho detto, un elemento cruciale è il tipping point, ossia il momento in cui un’innovazione passa dall’essere adottata solo dai primi utenti a diventare accettata dalla maggioranza del mercato e segna il passaggio dalla fase iniziale di adozione a una crescita accelerata e autoalimentante, grazie al passaparola e alla crescente accettazione sociale, non è così nella curva della Disruption. Nella curva della disruption infatti il tipping point è molto più rapido e acuto, con un’adozione di massa che avviene quasi simultaneamente tra gli early adopters e la majority.

Le variabili che impattano la curva della disruption includono la frequenza delle innovazioni, la velocità di adozione e l’ampiezza del picco. Con l’avvento delle tecnologie digitali, infatti, la frequenza delle innovazioni disruptive è aumentata notevolmente e sta accelerando progressivamente, con nuove tecnologie che emergono a un ritmo sempre più rapido. La velocità di adozione sia lato aziende, che lato utenti, è anche significativamente aumentata, grazie alla pervasività di internet, ai social media che permettono una diffusione ed una viralità quasi istantanea delle nuove idee, prodotti e servizi. L’ampiezza del picco nella curva della disruption è molto più elevata rispetto alla curva di Rogers, indicando che una grande percentuale del mercato può essere rapidamente raggiunta e conquistata da una nuova innovazione.

Downes e Nunes, nel loro modello, hanno inoltre identificato tre caratteristiche principali che definiscono i Big Bang Disruptors:

- “Undisciplined Strategy” implica che questi disruptors competono simultaneamente su molteplici valori strategici, offrendo prodotti che sono sia migliori che più economici rispetto a quelli dei concorrenti. In secondo luogo;

- “Unconstrained Growth” descrive una crescita rapida e quasi verticale, seguita da un’obsolescenza altrettanto veloce;

- “Unencumbered Development” riguarda la sperimentazione rapida e il lancio di prodotti utilizzando componenti pronti all’uso.

Queste dinamiche hanno effetti profondi, come evidenziato da Downes e Nunes sulla ricerca e sviluppo (R&S) e sull’approccio alla capacità di resistere all’impatto dei cambiamenti e alla capacità delle aziende di “surfare” l’onda.

La necessità di innovazione continua diventa cruciale, con le aziende che devono investire costantemente in R&S per rimanere competitive e non lasciare al caso o alla rincorsa del cambiamento. L’attenzione si sposta verso la creazione di valore e innovazioni che possano innescare un meccanismo virtuoso incrementale o ancora di più verso innovazioni in grado di cambiare radicalmente e in modo dirompente i mercati esistenti, anziché migliorare solo marginalmente i prodotti esistenti. In questa fase, come descritto dai due autori del libro, le aziende devono sviluppare una forte capacità di adattamento per rispondere rapidamente ai cambiamenti del mercato e implementare strategie di mitigazione dei rischi, come la diversificazione del portafoglio prodotti e la flessibilità operativa.

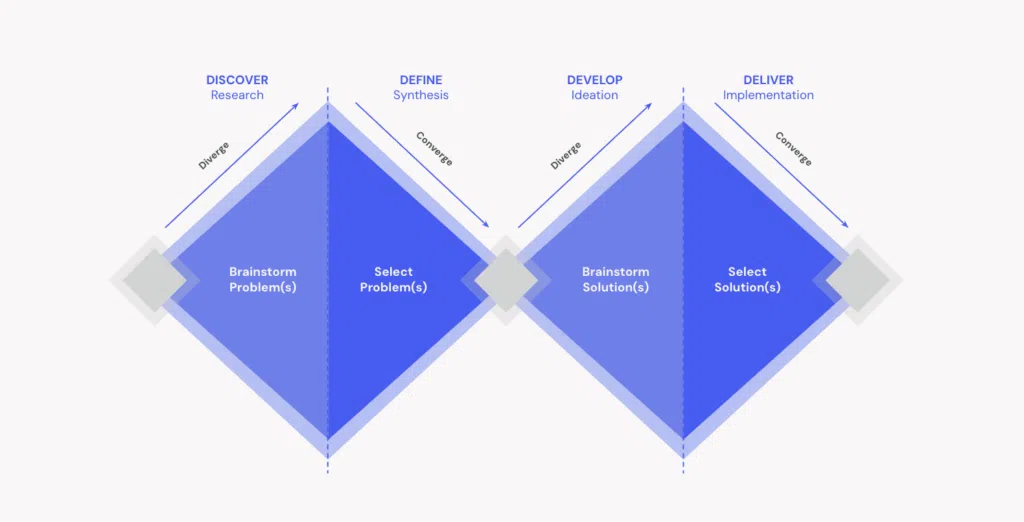

Per affrontare l’impatto della disruption, le aziende sono state sollecitate ad adottare metodologie agili, snelle e adattative come Scrum e Kanban, per esempio, per migliorare la gestione dei progetti in modo flessibile e iterativo. Il Design Thinking, esploso nell’ultima decade, con il suo approccio centrato sull’utente e l’iterazione continua, è stato fondamentale per molte aziende per creare soluzioni innovative orientate alla risoluzione di problemi reali. La metodologia Lean Startup, con il ciclo Build-Measure-Learn, ha introdotto approcci e mindset orientati a sviluppare prodotti minimamente validi (MVP) e di iterare rapidamente basandosi sui feedback degli utenti, così da poter presidiare più rapidamente il mercato con un rapido time to market, un approccio incrementale ed una mitigazione del rischio di fallimento.

Un ulteriore approccio cruciale che è nato nel periodo della Disruption è anche quello del Platform Design, un approccio che permette, in sintesi, di ridefinire l’approccio e la progettazione della azienda facilitando l’interazione tra diversi attori dell’ecosistema. Questo include la standardizzazione dei protocolli e l’apertura dei servizi, e l’integrazione e creazione di un ecosistema di servizio che permette alle aziende di interagire facilmente con nuove tecnologie e di collaborare con partner esterni, accelerando l’innovazione e ampliando le capacità di sviluppo.

L’Open Innovation infine, negli ultimi anni, ha incoraggiato la collaborazione estesa con partner esterni, startup, università, community di territorio, e clienti, per accelerare l’innovazione e ampliare le capacità di sviluppo. Non ultimo lo Scenario Planning ossia una metodologia strategica che esplora diverse possibilità future per aiutare le organizzazioni a prepararsi all’incertezza. Identificando variabili chiave come cambiamenti tecnologici ed economici, si sviluppano scenari alternativi per capire meglio i potenziali impatti. Questo approccio permette (e sta permettendo) di creare strategie flessibili e resilienti, capaci di adattarsi a diverse evoluzioni del contesto, favorendo una preparazione robusta e la mitigazione dei rischi.

L’integrazione di questi approcci, metodologie, cambio di mindset sta consentendo alle aziende di essere più resilienti e adattabili, e allo stesso tempo robuste, rispondendo prontamente ai cambiamenti del mercato, mantenendo la competitività in un ambiente in rapida evoluzione.

Innovation Shockwave Curve: l’arrivo dell’AI e la convergenza tecnologica

Negli ultimi anni ho affrontato questi temi di cui ho scritto fin qui, di impatto ed innovazione, con differenti aziende clienti e partner affrontando, in industrie diverse, le modalità di gestione e sviluppo delle nuove tecnologie, dei nuovi media, dei linguaggi di diverse generazioni e come queste dovessero esser affrontate con metodologie e piattaforme sempre più adeguate, e con approcci di pensiero strategico sempre più snelli e adattativi.

Negli ultimi mesi, grazie al lavoro fatto su diverse piattaforme e dal confronto con diversi professionisti, ho iniziato a riflettere sulle ripercussioni derivanti oggi dall’AI e dalle nuove opportunità e complessità da affrontare considerata questa “nuova” onda d’urto che sta arrivando.

Questa onda d’urto l’ho definita, già in diverse riunioni, la Innovation Shockwave Curve. Un concetto che descrive a mio avviso bene (sia in termini letterari che visuali) come l’intelligenza artificiale (AI) e altre tecnologie sempre più mature, in questa fase di convergenza e shift di cui parlo da un po’, stanno ridefinendo il panorama dell’innovazione.

La Shockwave Curve è un concetto emergente che descrive come l’intelligenza artificiale (AI) e altre tecnologie avanzate stiano ridefinendo il panorama dell’innovazione. Questo modello è nato dall’osservazione delle rapide e intense ondate di adozione che sta avendo l’AI e le altre tecnologie, che superano (e supereranno) i tradizionali modelli di diffusione dell’innovazione e di Disruption a mio avviso, andando oltre la previsione di Downes e Nunes.

ll termine “Innovation ShockWave Curve” l’ho scelto per descrivere un nuovo modello di adozione delle innovazioni caratterizzato da una rapida diffusione, un picco elevato e una fase di assestamento con continue iterazioni e che combina impatti intensi, appunto come uno shock le innovazioni emergono con un impatto immediato e significativo sul mercato e una diffusione rapida, proprio come un’onda le innovazioni si propagano velocemente attraverso il mercato, raggiungendo un’adozione massiva in breve tempo.

Con l’introduzione della Shockwave Curve, le caratteristiche chiave dei Big Bang Disruptors subiscono ulteriori evoluzioni per adattarsi al nuovo contesto tecnologico e di mercato dominato dall’intelligenza artificiale e dalle tecnologie convergenti. Ho mantenuto le stesse classificazioni per facilità di ragionamento:

- Strategia indisciplinata (Undisciplined Strategy): mentre nella Big Bang Disruption i disruptors competono simultaneamente su molteplici valori strategici, offrendo prodotti migliori e più economici, nella Shockwave Curve questa strategia diventa ancora più pronunciata. La rapida iterazione e l’ottimizzazione continua consentita dall’AI permettono ai disruptors di personalizzare e adattare i prodotti in tempo reale alle esigenze dei clienti, aumentando ulteriormente la loro competitività su tutti i fronti.

- Crescita senza vincoli (Unconstrained Growth): la crescita rapida e quasi verticale dei Big Bang Disruptors si intensifica nella Shockwave Curve. Grazie alle capacità predittive e di automazione dell’AI, la velocità di adozione diventa ancora più rapida, permettendo ai disruptors di scalare e raggiungere il mercato di massa in tempi record. Tuttavia, anche l’obsolescenza avviene più velocemente, con nuove ondate di innovazione che emergono costantemente e soppiantano rapidamente le tecnologie precedenti.

- Sviluppo svincolato (Unencumbered Development): la capacità di sperimentare e lanciare rapidamente prodotti utilizzando componenti pronti all’uso, già evidente nella Big Bang Disruption, viene ulteriormente potenziata nella Shockwave Curve. Le tecnologie AI facilitano lo sviluppo e la sperimentazione continua, consentendo ai disruptors di iterare rapidamente e migliorare costantemente i loro prodotti. Questo ciclo accelerato di sviluppo e implementazione diventa fondamentale per mantenere il vantaggio competitivo in un mercato in continua evoluzione.

Per spiegare meglio la dinamica della Shockwave, ecco alcune differenze sostanziali a mio avviso:

- Forma della Curva: Curva di Rogers: Una distribuzione normale, con una diffusione lenta e graduale. Curva della Disruption: Una rapida ascesa e declino, simile a una pinna di squalo. Shockwave Curve: Una rapida adozione iniziale, un picco molto alto e un periodo di assestamento con continue iterazioni, somigliante a un’onda d’urto.

- Tempo di Adozione: Curva di Rogers: L’adozione avviene in anni o decenni. Curva della Disruption: L’adozione può avvenire in diversi mesi o pochi anni. Shockwave Curve: L’adozione è estremamente rapida, spesso in pochi mesi, grazie all’AI e alle tecnologie digitali.

- Tipping Point: Curva di Rogers: Un punto critico dove l’adozione passa dalla minoranza alla maggioranza. Curva della Disruption: Un tipping point rapido e acuto. Shockwave Curve: Il tipping point è quasi istantaneo, con una diffusione simultanea tra early adopters e majority.

Le variabili già descritte anche nel modello della Disruption cambiano di nuovo:

- Frequenza: Le innovazioni supportate dall’AI emergono a una frequenza molto alta, creando ondate successive di adozione, con impatto su diverse altre tecnologie e ambiti.

- Velocità: La velocità di adozione è estremamente rapida, facilitata dalla connettività globale e dai sistemi AI che accelerano lo sviluppo e la distribuzione delle innovazioni.

- Ampiezza: L’ampiezza del picco è molto elevata, indicando una rapida e vasta adozione, spesso coinvolgendo gran parte del mercato in tempi brevi.

Per quanto riguarda gli effetti che avrà sui processi di ricerca e sviluppo e sull’approccio che le aziende dovranno adottare per mitigare gli impatti e affrontare il repentino cambiamento e una aggressiva competizione, sarà necessario:

- implementare processi di Innovazione Continua: le aziende dovranno investire costantemente in R&S per sviluppare tecnologie e modelli innovativi e sarà necessario rivedere il concetto purtroppo radicato che “Innovazione = costo”

- focalizzare l’attenzione senza dubbio su AI e automazione: l’attenzione si concentrerà su tecnologie che possono essere rapidamente iterate e migliorate.

- allenare l’adattabilità: le aziende dovranno essere estremamente flessibili per rispondere rapidamente alle nuove ondate di innovazione e rivedere modelli di offerta in funzione di un cambiamento repentino anche delle abitudini di consumo e comportamento del mercato

- definire strategie di mitigazione: sarà sempre più necessario intervenire su processi e strategie per anticipare e rispondere ai rapidi cambiamenti del mercato, come la diversificazione e la flessibilità operativa, e la mitigazione di rischi operativi

Per quanto io veda nelle fasi di enorme cambiamento opportunità di sviluppo e crescita, credo che questa fase, per via di questa onda d’urto, si potrebbero creare e potrebbero emergere non pochi effetti collaterali che provo a buttare giù a livello di macro-pensiero:

- Saturazione del mercato: ogni mercato ha un limite massimo di adozione, oltre il quale non è possibile acquisire nuovi utenti senza sottrarli ad altri. Quando un’innovazione raggiunge una crescita come quella che stiamo vedendo, ad un certo punto (ed in questo caso presto), la crescita inevitabilmente rallenta e inizierà a decrescere quando non ci saranno più nuovi utenti da acquisire, o quando la velocità di acquisizione di nuovi utenti non potrà più compensare la perdita di quelli esistenti.

- Stanchezza da innovazione: un’accelerazione costante e la frequente introduzione di nuove tecnologie possono portare il mercato a “stancarsi” del continuo cambiamento. La “fatigue” dell’innovazione si verifica quando i consumatori diventano meno inclini a provare nuovi prodotti o servizi a causa dell’eccesso di novità. La resistenza al cambiamento aumenta, e i tassi di adozione iniziano a declinare poiché i consumatori preferiscono stabilità e familiarità.

- Limiti di risorse: le risorse necessarie per sviluppare, produrre e distribuire innovazioni non saranno illimitate, ed in alcuni contesti cominciamo a vedere già alcuni. Costi crescenti e la competizione per risorse scarse potranno rallentare il ritmo dell’innovazione. Le aziende rischiano di incontrare difficoltà nel mantenere il ritmo di innovazione, portando automaticamente ad un rallentamento nella diffusione di nuove tecnologie.

- Effetti di cannibalizzazione: le nuove innovazioni spesso sostituiscono quelle esistenti. Quando le nuove tecnologie cannibalizzano il mercato delle tecnologie precedenti senza espandere significativamente il mercato totale, il tasso complessivo di crescita può rallentare. La curva di crescita mostra un declino, poiché l’adozione di nuove innovazioni non genera un aumento netto degli utenti.

- Dinamiche economiche e sociali: i fattori macroeconomici come recessioni, cambiamenti nelle politiche governative o cambiamenti demografici possono influenzare la capacità di un mercato di adottare nuove tecnologie. Questi fattori possono portare a una stagnazione o a una riduzione nell’adozione delle innovazioni, interrompendo il modello della Shockwave Curve.

- Aumento della concorrenza: la rapida diffusione delle innovazioni altamente impattanti e generative, come l’AI appunto, crea mercati altamente competitivi. Le aziende devono competere non solo con le imprese tradizionali ma anche con nuove startup, più agili snelle e maggiormente aggressive in termini di capacità di insediamento sul mercato. L’aumento della concorrenza portare automaticamente ad una riduzione dei margini di profitto e a una maggiore pressione per innovare continuamente.

- Dipendenza dall’innovazione continua: un tema che non avrei pensato anni fa, è il tema della dipendenza (e da effetto Fomo). Le aziende non possono più non fare innovazione, ma ne potrebbero diventare troppo dipendenti, con la necessità costante di introdurre costantemente nuove proposizioni o miglioramenti di offerta. Questa rincorsa potrebbe generare, come sta succedendo già con l’effetto FOMO, a decisioni affrettate, investimenti rischiosi e un focus eccessivo sull’innovazione a breve termine a scapito della stabilità a lungo termine.

- Disuguaglianze di accesso: le innovazioni tecnologiche raggiungono prima i mercati sviluppati, lasciando indietro i mercati emergenti. Questa dinamica crea potenzialmente una disuguaglianza nell’accesso alle tecnologie avanzate, esacerbando le disparità economiche e sociali.

- Impatto ambientale: non ultimo un tema oggi più che mai attuale. La produzione e lo smaltimento rapidi di nuovi dispositivi tecnologici e di sistemi dall’impatto enorme in termini di consumo, possono avere effetti negativi sull’ambiente e sul consumo di risorse naturali.

Le metodologie fin ora adottate e suggerite anche dal precedente modello della BigBang Disruption, rimangono essenzialmente le stesse, centrate principalmente su alcuni principi: progettazione sempre più utente centrica, agilità di processo e metodo, collaborazione multidisciplinare per comprendere non solo gli impatti tecnici, ma anche sociali, economici, psicologici e normativi.

Per affrontare l’impatto della Shockwave Curve, le aziende dovranno continuare ad adottare diverse metodologie:

- Metodologie Agili: Framework come Scrum e Kanban permettono una gestione flessibile e iterativa dei progetti.

- Design Thinking: Approccio centrato sull’utente e iterazione continua per sviluppare soluzioni che risolvano problemi reali.

- Lean Startup: Ciclo Build-Measure-Learn per sviluppare MVP e iterare rapidamente basandosi sui feedback degli utenti.

- Platform Design: Creazione di piattaforme che facilitano l’interazione tra diversi attori dell’ecosistema, standardizzazione dei protocolli e apertura dei servizi attraverso API.

- Open Innovation: Collaborazione estesa con partner esterni, startup, università e clienti per accelerare l’innovazione.

- Scenario Planning: Previsione e preparazione per diverse possibili evoluzioni del mercato, sviluppando strategie per affrontare ciascun scenario.

Dato l’impatto estremamente rapido e intenso della Shockwave Curve, oltre metodologie agili, Design Thinking, Lean Startup, Platform design, Open Innovation e Scenario Platform sarà a mio avviso necessario sviluppare e adattare nuove metodologie per affrontare le sfide specifiche che questa nuova onda presenterà.

Credo, anche per l’esperienza che sto facendo su alcuni ambiti di industria, che sarà necessario includere:

- AI-Driven Innovation: utilizzo di algoritmi di intelligenza artificiale per anticipare le tendenze e adattare rapidamente le strategie.

- Continuous Deployment & Integration: processi automatizzati per implementare continuamente nuove funzionalità e miglioramenti, riducendo il tempo di risposta ai cambiamenti del mercato.

- Ecosystem-Oriented Development: prodottizzazione di alcuni procesi, sviluppo di servizi con un approccio integrato all’ecosistema, favorendo la collaborazione tra diversi attori del mercato e sfruttando le sinergie.

- Adaptive Governance: strutture di governance flessibili che permettano decisioni rapide e decentralizzate, facilitando l’innovazione continua e l’adattamento alle nuove condizioni di mercato.

- Real-Time Analytics & Decision Making: Utilizzo di strumenti di analisi in tempo reale per prendere decisioni rapide e informate, migliorando la capacità di reagire ai cambiamenti del mercato.

La curva di innovazione ha subito un’evoluzione significativa dalle prime fasi rappresentate dalla curva gaussiana, attraverso la fase della curva a pinna di squalo, fino alla recente “emergenza” di fronteggiare l’onda d’urto della innovation shockwave curve, influenzata dall’AI.

Questa transizione riflette senza dubbio l’accelerazione e la dinamizzazione dei processi di innovazione nel contesto tecnologico attuale. Le aziende che non sapranno, più di prima, adattarsi subiranno non più l’effetto travolgente di una onda di grandi dimensioni, ma l’impatto di un muro verso cui si sta correndo senza possibilità di frenare. L’agilità e l’innovazione continueranno ad esser non una certezza di salvataggio, ma un approccio utile per interpretare, comprendere e adattarsi nell’era dell’intelligenza artificiale e delle tecnologie convergenti.

Dello Shift che stiamo vivendo ne ho scritto nel libro “Spatial Shift: La convergenza tecnologica di Computing, Mixed Reality, Artificial Intelligence e Blockchain” trattando in modo specifico lo shift della mixed reality e dell’AI, focalizzandomi sugli impatti dello Spatial Computing, ossia una piccola parte del grande cambiamento che stiamo vivendo.

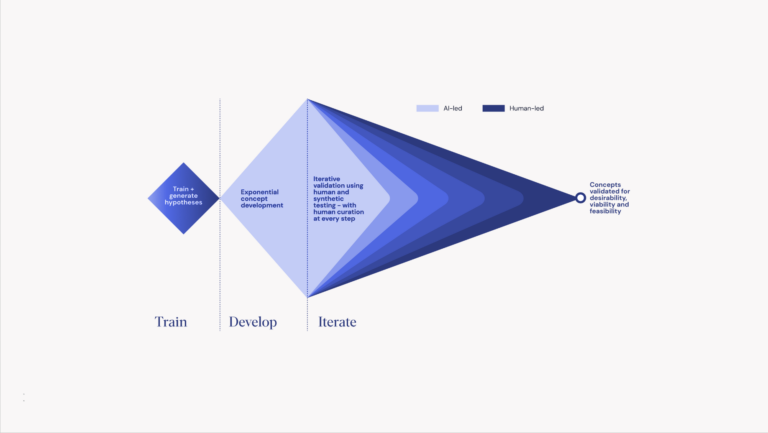

La sua forza risiede nella semplicità e nella struttura, che hanno guidato migliaia di individui e team globalmente, orientando investimenti miliardari. Tuttavia, l’emergere dell’innovazione guidata dall’intelligenza artificiale sta mettendo in discussione la sua rilevanza. Nato in un’epoca in cui i progetti erano limitati dalla quantità di Post-It su un muro e dalla capacità di elaborazione del cervello umano, il Double Diamond si appoggiava a strumenti come PowerPoint, Excel e Photoshop, lontani dalle potenzialità dell’odierna data science e GenAI.

La sua forza risiede nella semplicità e nella struttura, che hanno guidato migliaia di individui e team globalmente, orientando investimenti miliardari. Tuttavia, l’emergere dell’innovazione guidata dall’intelligenza artificiale sta mettendo in discussione la sua rilevanza. Nato in un’epoca in cui i progetti erano limitati dalla quantità di Post-It su un muro e dalla capacità di elaborazione del cervello umano, il Double Diamond si appoggiava a strumenti come PowerPoint, Excel e Photoshop, lontani dalle potenzialità dell’odierna data science e GenAI.