Anthropic e Claude AI: il futuro dell’assistenza digitale

Claude AI è sicuramente un segnale forte al mercato riguardo la prossima generazione di assistenti digitali intelligenti. Un sistema che combina capacità linguistiche avanzate con una nuova concezione di interazione etica e sicura. Questo modello, sviluppato da Anthropic, si distingue per la sua versatilità e precisione, offrendo una gamma di servizi che vanno dalla generazione di testo e codice alla sommarizzazione di documenti e al supporto decisionale. Con la promessa di un’interfaccia utente intuitiva e una straordinaria facilità di integrazione, Claude AI si presenta come una soluzione robusta per gli utenti che cercano un’esperienza di AI conversazionale più riflessiva e responsabile.

Cosa è Anthropic AI

Anthropic AI è una startup di intelligenza artificiale focalizzata sulla sicurezza, interpretabilità e controllabilità dei sistemi AI, fondata da un gruppo di ex ricercatori di OpenAI, tra cui spiccano i fratelli Dario e Daniela Amodei. L’ambizione di Anthropic è quella di sviluppare tecnologie AI che non solo avanzino le frontiere della ricerca e dell’applicazione pratica ma che lo facciano in modo sicuro ed etico, affrontando proattivamente i rischi potenziali associati ai sistemi di intelligenza artificiale generativa e di grandi dimensioni.

La Missione e la Visione di Anthropic

La missione di Anthropic si concentra sulla creazione di sistemi AI che siano affidabili, comprensibili dall’uomo e in grado di operare secondo principi etici ben definiti. Questo impegno nasce dalla convinzione che, mentre l’IA presenta un potenziale immenso per il bene sociale, economico e tecnologico, la sua evoluzione debba essere guidata da una comprensione profonda dei suoi impatti e da un impegno verso la minimizzazione dei rischi. Anthropic si pone quindi come pioniere nell’ambito della “AI Safety”, promuovendo un approccio alla ricerca e allo sviluppo che tenga conto delle implicazioni etiche e della sicurezza fin dalle fasi iniziali.

Differenze e Innovazioni

Rispetto ad altre realtà nel campo dell’IA, Anthropic si distingue per il suo approccio denominato “Constitutional AI”. Questa metodologia innovativa prevede la creazione di modelli di IA che seguano un insieme di principi costituzionali, una sorta di “codice etico”, che guida il comportamento dell’IA in situazioni complesse, garantendo che le sue azioni e risposte siano allineate con valori umani fondamentali come la sicurezza, la privacy e il rispetto dell’individuo.

Contributi e Impatto sul Campo dell’IA

Dal suo lancio, Anthropic ha guadagnato riconoscimenti per i suoi contributi significativi alla comunità dell’IA, compresa la pubblicazione di ricerche pionieristiche e lo sviluppo di Claude, il suo modello di punta. Con finanziamenti da giganti tecnologici come Google e Amazon, Anthropic ha solidificato la sua posizione come uno degli attori chiave nello sviluppo futuro dell’IA. La sua enfasi sulla trasparenza, sull’interpretabilità dei modelli e sulla collaborazione aperta con la comunità scientifica e tecnologica evidenzia un percorso verso un’IA che sia non solo avanzata ma anche al servizio dell’umanità.

Cosa è Claude AI?

Claude AI rappresenta la frontiera più avanzata nell’ambito dell’intelligenza artificiale conversazionale, sviluppata dalla startup Anthropic con l’intento di creare un assistente digitale non solo altamente competente ma anche eticamente consapevole. Nato dalla visione di ex ricercatori di OpenAI, Claude si distingue nel panorama IA per la sua capacità di condurre conversazioni naturali, fornendo risposte comprensive e dettagliate attraverso l’impiego di modelli linguistici di grande dimensione, i cosiddetti Large Language Models (LLMs).

La Genesi di Claude

L’origine di Claude AI affonda le radici nell’esperienza accumulata dai suoi creatori durante il loro lavoro su GPT-3 presso OpenAI, da cui hanno tratto ispirazione per migliorare e raffinare l’approccio alla creazione di sistemi di IA conversazionale. Diversamente da altri modelli esistenti, Claude è stato progettato per superare specifiche sfide legate alla sicurezza, all’interpretazione dei dati e alla direzionalità delle risposte fornite, ponendo le basi per un modello di IA che rispetti principi etici ben definiti.

Le Capacità Uniche di Claude

Claude si distingue per le sue eccezionali capacità di elaborazione del linguaggio, che gli consentono di affrontare un’ampia gamma di compiti: dalla sommarizzazione di testi all’editing, dalla risposta a domande complesse alla scrittura di codice, fino alla facilitazione di processi decisionali. Una delle sue caratteristiche più innovative è la possibilità di leggere e comprendere documenti fino a 75.000 parole, offrendo agli utenti la capacità di esplorare e interagire con quantità di informazioni paragonabili a quelle contenute in un libro breve. Questa funzionalità apre nuove prospettive nell’utilizzo dell’IA per supportare la ricerca accademica, l’analisi di dati complessi e la creazione di contenuti.

Un Modello Etico e Sicuro

Un aspetto che distingue profondamente Claude dagli altri modelli di IA è il suo impegno verso la sicurezza e l’etica. Anthropic ha introdotto un approccio rivoluzionario denominato “Constitutional AI”, attraverso il quale il modello viene allenato seguendo un insieme di principi etici predefiniti, mirati a massimizzare l’impatto positivo delle sue interazioni evitando allo stesso tempo consigli dannosi o comportamenti indesiderati. Questa metodologia non solo garantisce una maggiore affidabilità delle risposte di Claude ma promuove anche un uso responsabile dell’IA, in linea con le aspettative della società moderna.

Claude: Un Nuovo Standard nelle Conversazioni AI

Claude AI si posiziona come un vero e proprio punto di riferimento nel panorama delle intelligenze artificiali conversazionali, segnando un’avanzata significativa rispetto ai modelli precedenti. Offrendo tre versioni principali – Claude 1, Claude 2 e Claude Instant – Anthropic si rivolge a una vasta gamma di utenti, dalle esigenze personali a quelle aziendali, definendo nuovi standard in termini di interattività e funzionalità.

Le Diverse Facce di Claude

Ogni versione di Claude è stata progettata con obiettivi specifici in mente. Claude 1 pone le basi con una solida comprensione del linguaggio naturale e la capacità di interagire in modo significativo, mentre Claude 2 estende queste capacità con un’elaborazione più profonda e una maggiore comprensione del contesto. Claude 2 è progettato per leggere e analizzare grandi volumi di testo, rendendolo ideale per compiti che vanno dall’analisi di dati complessi al supporto decisionale. Claude Instant, d’altra parte, offre una soluzione più agile e veloce, adatta per interazioni rapide che richiedono tempi di risposta immediati, pur mantenendo una qualità di conversazione elevata.

Comparazione delle Capacità

Nel confronto diretto delle capacità, Claude 1 e Claude 2 dimostrano una competenza notevole nella conversazione e nella scrittura creativa, con Claude 2 che mostra un’abilità superiore nell’analisi di testi estesi e nella gestione di dati complessi. La versione Instant, pur non avendo la stessa profondità di comprensione, compensa con la sua rapidità, rendendola un’opzione ideale per gli sviluppatori che necessitano di integrare una componente AI conversazionale nei loro prodotti senza compromettere le prestazioni.

La capacità di Claude di scrivere codice è un altro punto di forza, in particolare con Claude 2, che può generare algoritmi e aiutare nella risoluzione di problemi di programmazione con una comprensione del linguaggio e delle sue applicazioni che va oltre la semplice generazione di testo. Questa poliedricità rende Claude un partner ideale per una varietà di utenti, dai content creator ai data scientist, fino agli sviluppatori di software.

Caratteristiche Tecniche e Modelli di Algoritmo di Claude AI

Claude AI, sviluppato da Anthropic, si basa su una serie di innovazioni tecniche e concettuali che lo distinguono nell’ambito dell’intelligenza artificiale conversazionale. Al cuore di Claude giace una struttura di modelli di algoritmi avanzati, definiti come Large Language Models (LLMs), che si avvalgono di tecniche di apprendimento profondo e di vasti corpus di dati testuali per generare risposte coerenti, accurate e contestualizzate.

Architettura e Dimensioni del Modello

Una delle caratteristiche principali di Claude è la sua architettura basata su Transformer, un tipo di modello di apprendimento automatico che ha rivoluzionato il campo del Natural Language Processing (NLP). I modelli Transformer sono particolarmente efficaci nel catturare relazioni complesse all’interno di sequenze di dati, come il testo, grazie alla loro capacità di gestire dipendenze a lungo termine tra le parole. Claude si avvale di questa architettura con un numero significativo di parametri, nell’ordine delle decine di miliardi, che gli conferiscono una notevole capacità di comprensione e generazione del linguaggio.

Apprendimento e Fine-tuning

Il processo di apprendimento di Claude si basa su tecniche di fine-tuning avanzate, dove il modello pre-addestrato su ampi dataset viene ulteriormente ottimizzato per specifici compiti o per aderire a particolari principi etici, come quelli definiti nell’approccio di Constitutional AI di Anthropic. Questo processo di fine-tuning permette a Claude di allinearsi a un insieme di valori e obiettivi predefiniti, migliorando la sua affidabilità e la sua sicurezza nell’interazione con gli utenti.

Constitutional AI

Una delle innovazioni più significative introdotte con Claude è l’approccio Constitutional AI. A differenza dei tradizionali sistemi di apprendimento automatico, che si basano su feedback umano per guidare le risposte del modello, il Constitutional AI di Claude integra una “costituzione” di principi etici direttamente nel processo di apprendimento. Questo insieme di regole guida il modello nelle sue risposte, assicurando che siano allineate con valori come la non nocività, la privacy e il rispetto dell’autonomia dell’utente. Tale approccio non solo migliora l’etica operativa di Claude ma ne aumenta anche la trasparenza e l’interpretabilità.

Capacità di Elaborazione e Interazione

Grazie alla sua avanzata architettura e al suo ampio training, Claude è in grado di elaborare fino a 75.000 parole in un’unica sessione, permettendo un’analisi approfondita di documenti estesi. Questa capacità supera di gran lunga quella dei suoi concorrenti, rendendo Claude uno strumento particolarmente potente per la sintesi di informazioni, l’analisi di dati e la generazione di contenuti complessi.

Claude AI è Meglio di ChatGPT?

La questione se Claude sia superiore a ChatGPT si presta a una risposta sfumata: sì e no. L’analisi comparativa rivela che Claude eccelle in alcuni benchmark rispetto a ChatGPT, mentre in altri aspetti rimane indietro. Una distinzione chiave emerge tra le versioni gratuite e a pagamento di entrambi i sistemi: Claude gratuito si dimostra superiore alla versione gratuita di ChatGPT, ma la sottoscrizione a pagamento di ChatGPT offre funzionalità avanzate e una base di conoscenza più ampia rispetto a quella di Claude.

Analisi Comparativa e Benchmark

La valutazione dell’intelligenza di un sistema AI non può essere esauriente e solleva interrogativi su quali benchmark siano più affidabili. In questo contesto, la classifica dei chatbot di LMSYS emerge come uno strumento utile, proponendo un confronto diretto basato su tre criteri di valutazione principali:

- Valutazione Elo: Questo algoritmo, utilizzato originariamente per classificare i giocatori di scacchi, si basa su confronti ciechi fianco a fianco e sull’input umano per determinare quale risposta, e di conseguenza quale modello, sia il migliore. Claude e ChatGPT vengono messi a confronto in termini di capacità di generare risposte coerenti e pertinenti, con Claude che spesso prevale nella versione gratuita.

- MT-Bench: Questo benchmark valuta i modelli utilizzando GPT-4 e si avvale di sessioni di domande e risposte a più turni come coppie di input/output per la valutazione. Con una precisione fino all’80% rispetto alla valutazione umana, questo test offre una misura comparativa delle capacità di elaborazione e di risposta dei modelli.

- MMLU (Massive Multitask Language Understanding): Questo metodo valuta la conoscenza acquisita dai modelli durante l’addestramento, testando la loro capacità di rispondere a domande che richiedono vari livelli di comprensione su un’ampia gamma di argomenti. Claude supera il tier gratuito di ChatGPT in termini di rating Elo e prestazioni MMLU, ma GPT-4 mantiene un vantaggio nei tier più lenti e costosi.

Capacità Distintive e Limitazioni

Oltre alla conoscenza grezza, Claude si distingue per la sua abilità nell’analizzare, leggere e riassumere documenti lunghi, con un limite di 150 pagine sufficiente a gestire piccoli libri. Questa capacità rappresenta un vantaggio significativo per utenti che necessitano di elaborare grandi volumi di testo.

Claude Pro non offre molte delle funzionalità introdotte da ChatGPT+, come chat vocale, creazione di immagini, analisi dei dati, comprensione delle immagini e navigazione web. Questo lascia Claude Pro in una posizione di svantaggio competitivo rispetto a ChatGPT+ al medesimo punto di prezzo, indicando un’area in cui Claude deve migliorare per incrementare la sua quota di mercato.

Come Usare Claude AI

L’utilizzo di Claude AI, la piattaforma di intelligenza artificiale conversazionale sviluppata da Anthropic, rappresenta un salto qualitativo nell’interazione uomo-macchina grazie alla sua avanzata capacità di comprendere e rispondere in modo naturale e contestualizzato. Ecco una guida passo dopo passo su come iniziare ad utilizzare Claude AI, sia per scopi personali che professionali.

Passo 1: Accesso alla Piattaforma

Per accedere a Claude AI, visita il sito ufficiale e procedi con la creazione di un account. Questo richiederà di fornire alcuni dati base come l’indirizzo email e di impostare una password. Una volta completata la registrazione, potrai accedere alla dashboard di Claude, dove avrai la possibilità di interagire direttamente con l’IA.

Passo 2: Iniziare una Conversazione

Una volta entrato nella dashboard di Claude, ti troverai di fronte a un’interfaccia utente intuitiva e semplice. Qui, potrai digitare domande o comandi nel campo di testo dedicato. Claude è progettato per comprendere una vasta gamma di richieste, dalle domande generali sulla conoscenza del mondo alla generazione di testo creativo, dall’analisi di dati al supporto decisionale.

Passo 3: Utilizzare Documenti per Contestualizzare le Richieste

Una delle caratteristiche distintive di Claude è la sua capacità di elaborare documenti estesi, consentendoti di caricare pdf o documenti di testo per arricchire il contesto delle tue interazioni. Se hai un articolo, un rapporto o qualsiasi altro documento di cui desideri una sintesi, un’analisi o semplicemente porre domande specifiche, puoi caricarlo attraverso l’interfaccia utente. Claude lo analizzerà e utilizzerà le informazioni contenute per fornire risposte più accurate e contestualizzate.

Passo 4: Sfruttare le Capacità Avanzate di Claude

Esplora le diverse capacità di Claude chiedendo di scrivere codice, generare idee creative, fornire consulenza su decisioni complesse o qualsiasi altro compito supportato dal modello. Claude può anche essere utilizzato per esercizi di brainstorming, supporto allo studio, o semplicemente per soddisfare la tua curiosità su vari argomenti.

Passo 5: Iterare e Migliorare

Una delle chiavi per ottenere il massimo da Claude è sperimentare con diverse formulazioni delle tue richieste. Se non sei soddisfatto della risposta ottenuta, prova a riformulare la tua domanda o a fornire dettagli aggiuntivi per aiutare Claude a capire meglio il contesto. La piattaforma offre anche la possibilità di fornire feedback sulle risposte ricevute, contribuendo così a migliorare la qualità del servizio.

Accesso e Integrazione API di Claude AI

Una delle caratteristiche più interessanti di Claude AI è la sua flessibilità e facilità di integrazione in varie applicazioni tramite la sua Interfaccia di Programmazione delle Applicazioni (API). Questa capacità è particolarmente attraente per sviluppatori e aziende che mirano a incorporare un’intelligenza artificiale conversazionale sofisticata nei loro prodotti o servizi. Attraverso l’API di Anthropic, gli sviluppatori possono collegare senza problemi le loro applicazioni ai modelli linguistici avanzati di Claude, abilitando un’ampia gamma di funzionalità, dalla assistenza clienti automatizzata alla generazione dinamica di contenuti e oltre.

Il processo di accesso a Claude tramite API è progettato per essere semplice e amichevole per gli sviluppatori. Registrandosi al programma per sviluppatori di Anthropic, individui e organizzazioni possono ottenere chiavi API e accedere a una documentazione completa che li guida nell’integrare le capacità di Claude nei loro sistemi. L’API consente un controllo preciso sulle interazioni con Claude, inclusa la specifica della versione del modello (come Claude-1, Claude-2 o Claude-Instant), la personalizzazione dello stile conversazionale e l’impostazione dei parametri di risposta per adattarsi alle esigenze uniche di ogni applicazione.

Inoltre, il modello di prezzo pay-as-you-go dell’API assicura che gli sviluppatori paghino solo per le risorse computazionali che utilizzano, rendendolo una soluzione conveniente per progetti di tutte le dimensioni. Questo approccio consente anche una rapida prototipazione e scalabilità, poiché gli sviluppatori possono regolare il loro utilizzo in base alla domanda senza costi iniziali significativi. Con il supporto sia di Anthropic che di Amazon Bedrock, gli sviluppatori hanno la flessibilità di scegliere la piattaforma che meglio si adatta alle loro esigenze di distribuzione, sia che diano priorità alle massime prestazioni con Claude-2 o cercano la velocità e l’efficienza di Claude-Instant per interazioni in tempo reale.

Quanto Costa Claude AI?

Con l’avvento di Claude AI, la proposta di Anthropic nel mondo dell’intelligenza artificiale conversazionale, si apre un nuovo capitolo nel dialogo tra uomo e macchina. Una delle domande più frequenti riguarda il costo di accesso a questa tecnologia all’avanguardia. In questo articolo, esploriamo i diversi piani tariffari di Claude AI e confrontiamo le sue offerte con quelle del suo concorrente diretto, ChatGPT di OpenAI.

Accesso Gratuito e Claude Pro

Per l’utente medio, Anthropic fornisce accesso gratuito al loro modello di Claude AI più avanzato tramite la loro interfaccia di chat su claude.ai, ancora in fase di beta testing aperto a ottobre 2023. Per accedere, è sufficiente registrarsi e creare un account gratuito. Questo livello di accesso gratuito offre agli utenti l’ultimo e più capace modello di Claude, Claude 2, in netto contrasto con OpenAI che riserva GPT-4 agli abbonati di ChatGPT+.

Parallelamente, Anthropic propone Claude Pro a $20 al mese, un abbonamento analogo a ChatGPT+. Il piano Pro è pensato per quegli utenti che desiderano funzionalità aggiuntive e un supporto più ampio.

Prezzi per Sviluppatori e Imprese

Anthropic commercializza l’accesso ai suoi modelli a tre gruppi distinti: utenti standard, sviluppatori che desiderano integrare Claude nelle loro applicazioni e imprese che richiedono supporto a livello aziendale.

Per gli sviluppatori, è possibile ottenere l’accesso ai modelli di Claude tramite l’API di Anthropic o tramite Amazon Bedrock. Entrambi supportano un approccio on-demand, con prezzi basati sulla quantità di testo che si desidera che Claude elabori. I prezzi per mille “token” – che rappresentano la quantità di testo processato dal modello – variano in base ai costi di calcolo per input e output. La seguente tabella illustra i prezzi per mille token sia per input che per output, offrendo un confronto dei prezzi con i modelli GPT di OpenAI.

| Modello | Token Massimi | Costo per 1K Token Input | Costo per 1K Token Output |

|---|---|---|---|

| Claude-Instant | 100K | $0.00163 | $0.00551 |

| Claude-2 | 100K | $0.01102 | $0.03268 |

| GPT-3.5 | 4K | $0.0015 | $0.002 |

| GPT-4 | 8K | $0.03 | $0.06 |

Throughput Provisionato per Clienti Enterprise

AWS Bedrock offre ai clienti enterprise l’opzione “Throughput Provisionato”, che riserva capacità di calcolo su cloud dedicata alla loro attività. Questa opzione non è economica, ma consente di inviare richieste quanto necessario per un costo fisso, una volta che la capacità di calcolo è stata riservata. La sottoscrizione minima di un mese per il throughput con Amazon Bedrock ha un costo iniziale di $29,462.40 per il punto prezzo di Claude-Instant. La tabella seguente riporta il prezzo per ora della tua prenotazione:

| Modello | Costo/ora per 1 mese di impegno | Costo/ora per 6 mesi di impegno |

|---|---|---|

| Claude-Instant | $39.60 | $22.00 |

| Claude-2 | $63.00 | $35.00 |

Claude nell’Uso Quotidiano e Professionale

Claude AI di Anthropic si è rapidamente affermato come uno strumento versatile, utile non solo nel quotidiano degli utenti personali ma anche nelle operazioni professionali. Questo assistente digitale intelligente si adatta a svariate casistiche d’uso: è in grado di analizzare documenti lunghi, fornendo riassunti e insight profondi, e di generare codice, facilitando il lavoro di programmatori e sviluppatori. La capacità di Claude di comprendere e interagire in modo naturale lo rende uno strumento prezioso per settori che vanno dall’educazione all’industria creativa, dalla ricerca scientifica al marketing digitale.

Casi d’uso e Partnership di Successo: Quora, Notion, DuckDuckGo

Claude AI ha rapidamente guadagnato terreno non solo tra gli utenti individuali ma anche come partner tecnologico per aziende e piattaforme online rinomate. L’efficacia di Claude come strumento AI è stata ulteriormente validata attraverso collaborazioni di successo e testimonianze entusiastiche da parte di aziende come Quora, Notion e DuckDuckGo.

Quora e Claude: Una Conversazione Naturale

Quora, la piattaforma di domande e risposte, ha integrato Claude attraverso Poe, la loro app di chat AI, e i risultati hanno ricevuto feedback positivi. Gli utenti hanno descritto le risposte di Claude come dettagliate e di facile comprensione, apprezzando la naturalezza delle conversazioni. Questo testimonia l’abilità di Claude di fornire un’esperienza utente ricca e umana, oltrepassando la semplice fornitura di informazioni per creare un dialogo coinvolgente e significativo.

Notion e l’Assistenza AI di Claude

Notion, la piattaforma all-in-one per la gestione di note e progetti, ha adottato Claude AI per potenziare la loro nuova funzionalità di assistente AI connesso, Notion AI. La partnership ha permesso agli utenti di Notion di lavorare più efficacemente, migliorando le loro capacità di scrittura e organizzazione all’interno del loro spazio di lavoro digitale. Questa collaborazione sottolinea come Claude possa essere integrato in maniera fluida in strumenti esistenti per aumentare la produttività e arricchire l’esperienza degli utenti.

DuckDuckGo e l’Affidabilità di Claude

DuckDuckGo, noto per il suo impegno nella privacy degli utenti, ha scelto di collaborare con Anthropic per migliorare la qualità delle risposte fornite nel loro motore di ricerca. La partnership si è concentrata su DuckAssist, la prima risposta istantanea nei risultati di ricerca a utilizzare la tecnologia del linguaggio naturale per generare risposte a partire da Wikipedia e altre fonti correlate. Il lavoro congiunto ha permesso di migliorare la qualità delle risposte di DuckAssist, rispettando al contempo i rigorosi requisiti di privacy imposti dalla piattaforma.

Integrazione e Accessibilità di Claude

L’accesso e l’integrazione di Claude sono stati progettati per essere il più fluidi possibile. Anthropic ha fornito una guida dettagliata che accompagna gli utenti dalla configurazione iniziale fino all’interazione avanzata, assicurando che ogni passaggio sia intuitivo e accessibile. Gli sviluppatori possono sfruttare l’API di Claude per incorporarlo in applicazioni esistenti, mentre le aziende possono beneficiare del supporto a livello enterprise per implementazioni su larga scala.

Claude AI e l’Etica nell’Intelligenza Artificiale

L’etica è al centro della filosofia di Claude AI. Incorporando principi etici direttamente nel suo modello di apprendimento, Claude assicura che ogni interazione rispetti valori fondamentali come la privacy, la sicurezza e l’autonomia. Questo approccio etico si riflette in una maggiore trasparenza e accuratezza nelle risposte fornite, posizionando Claude come un modello di riferimento anche nel confronto con altre soluzioni AI come ChatGPT.

Claud AI e Anthropic, un percorso di investimenti e crescita

L’ascesa di Claud AI e Anthropic nel campo dell’intelligenza artificiale è stata caratterizzata da una serie di investimenti strategici e da una crescita esponenziale del valore aziendale. Nell’ultimo anno, Anthropic, noto per lo sviluppo del modello di linguaggio Claud AI, ha catturato l’attenzione di investitori di alto profilo, culminando in una serie di finanziamenti che hanno solidificato la sua posizione come serio concorrente nel settore dell’intelligenza artificiale conversazionale.

Nel corso delle discussioni per un nuovo round di finanziamenti, Anthropic ha ottenuto la fiducia di Menlo Ventures per una significativa iniezione di capitale di $750 milioni. Questo potenziale investimento potrebbe portare la valutazione dell’azienda a un incredibile $18.4 miliardi, segnando un notevole incremento rispetto alla precedente valutazione di $4.1 miliardi.

Un fattore chiave che ha contribuito a tale crescita è stato l’impegno di Google, che ha dimostrato la propria fiducia in Anthropic attraverso un impegno finanziario che potrebbe arrivare fino a $2 miliardi. Questo sostegno è parte di una strategia più ampia che include un’iniezione iniziale di $500 milioni seguita da ulteriori investimenti progressivi di $1.5 miliardi.

Le partnership di Anthropic con giganti tecnologici come Google, Salesforce e Zoom sottolineano l’importanza e la fiducia nell’approccio di Anthropic alla sicurezza e all’etica dell’IA. Il modello Claud AI, in particolare, si è distinto per le sue capacità avanzate, inclusa l’abilità di elaborare e riassumere testi estesi fino a 75,000 parole, un limite ben superiore a quello di ChatGPT.

Questa serie di investimenti testimonia la visione e la fiducia che il mercato ripone in Anthropic e Claud AI, non solo come innovatori nel campo dell’IA ma anche come leader emergenti in un’industria in rapido sviluppo. Con tali risorse finanziarie e una squadra di ricerca di primo livello, Anthropic è pronta a proseguire il suo percorso di innovazione e a plasmare il futuro dell’intelligenza artificiale conversazionale.

Prospettive Future per Claude e l’IA Conversazionale

Guardando al futuro, si prevede che Claude AI e Anthropic continueranno a essere pionieri nell’IA conversazionale. Con l’evoluzione costante di Claude e il suo impatto crescente sul mercato e sulla società, Anthropic mira a definire il cammino per un futuro in cui l’IA sia più sicura, più etica e più integrata nel tessuto sociale e professionale.

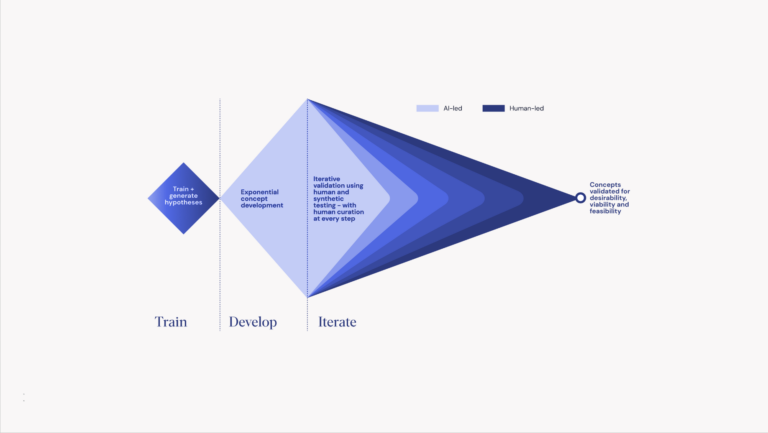

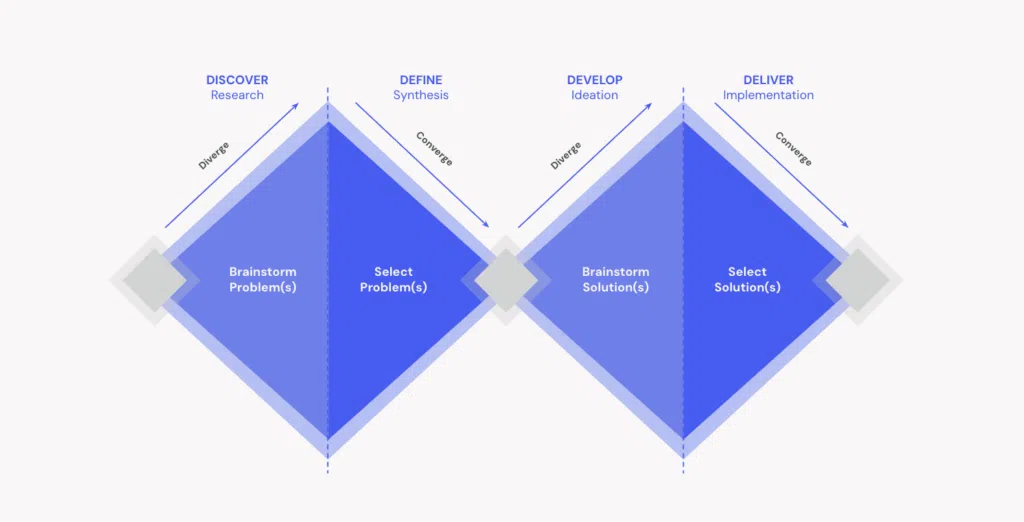

La sua forza risiede nella semplicità e nella struttura, che hanno guidato migliaia di individui e team globalmente, orientando investimenti miliardari. Tuttavia, l’emergere dell’innovazione guidata dall’intelligenza artificiale sta mettendo in discussione la sua rilevanza. Nato in un’epoca in cui i progetti erano limitati dalla quantità di Post-It su un muro e dalla capacità di elaborazione del cervello umano, il Double Diamond si appoggiava a strumenti come PowerPoint, Excel e Photoshop, lontani dalle potenzialità dell’odierna data science e GenAI.

La sua forza risiede nella semplicità e nella struttura, che hanno guidato migliaia di individui e team globalmente, orientando investimenti miliardari. Tuttavia, l’emergere dell’innovazione guidata dall’intelligenza artificiale sta mettendo in discussione la sua rilevanza. Nato in un’epoca in cui i progetti erano limitati dalla quantità di Post-It su un muro e dalla capacità di elaborazione del cervello umano, il Double Diamond si appoggiava a strumenti come PowerPoint, Excel e Photoshop, lontani dalle potenzialità dell’odierna data science e GenAI.