Comprensione e fiducia: l’evoluzione dell’interazione uomo-macchina

Cosa significa davvero interagire? Negli ultimi decenni, ci siamo abituati a pulsanti, comandi vocali, feedback visivi. A un mondo in cui le macchine rispondono alle nostre intenzioni. Fermandomi a riflettere tra varie letture di questi giorni di vacanza, mi sono più volte soffermato su una domanda: possiamo dire che la tecnologia, oggi, interagisce con noi realmente? Oppure si limita a reagire, ad eseguire ciò che le chiediamo?

L’interattività è stata una rivoluzione. Senza dubbio. Grazie alla Human-Computer Interaction (HCI), abbiamo progettato sistemi ergonomici, intuitivi, capaci di rendere il dialogo con la tecnologia fluido e accessibile. Le interfacce sono diventate estensioni naturali del nostro modo di pensare e agire: dallo sviluppo delle interfacce grafiche, al touch, passando per quelle vocali e basate sul linguaggio naturale. Ogni progresso ha reso l’interazione più fluida, ma ha mantenuto un limite: tutto è rimasto vincolato alla nostra capacità di guidare, immaginare e – in parte – governare la tecnologia. E tutto questo, per quanto avanzato, si inizia dove iniziamo noi e si ferma dove ci fermiamo noi.

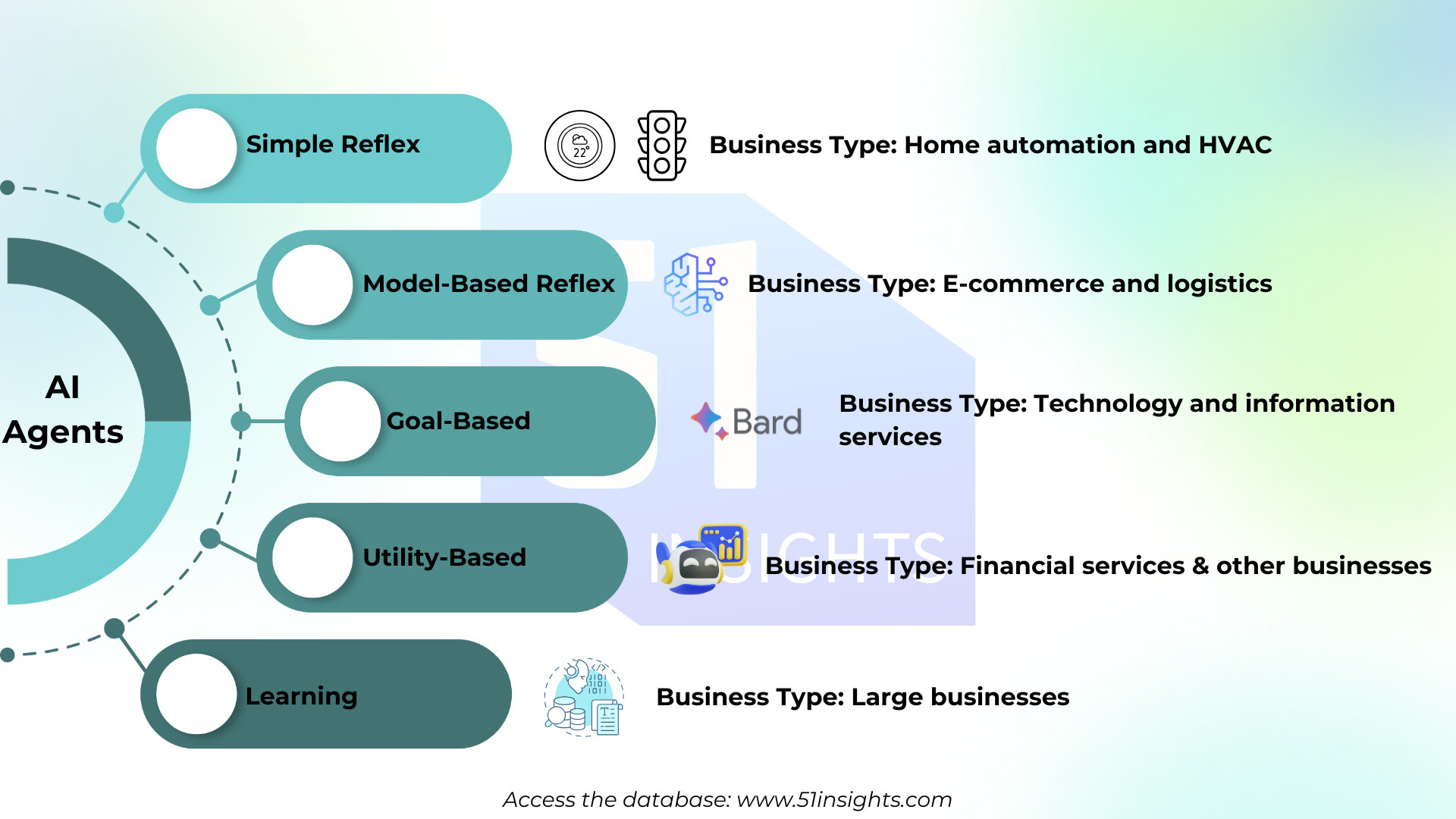

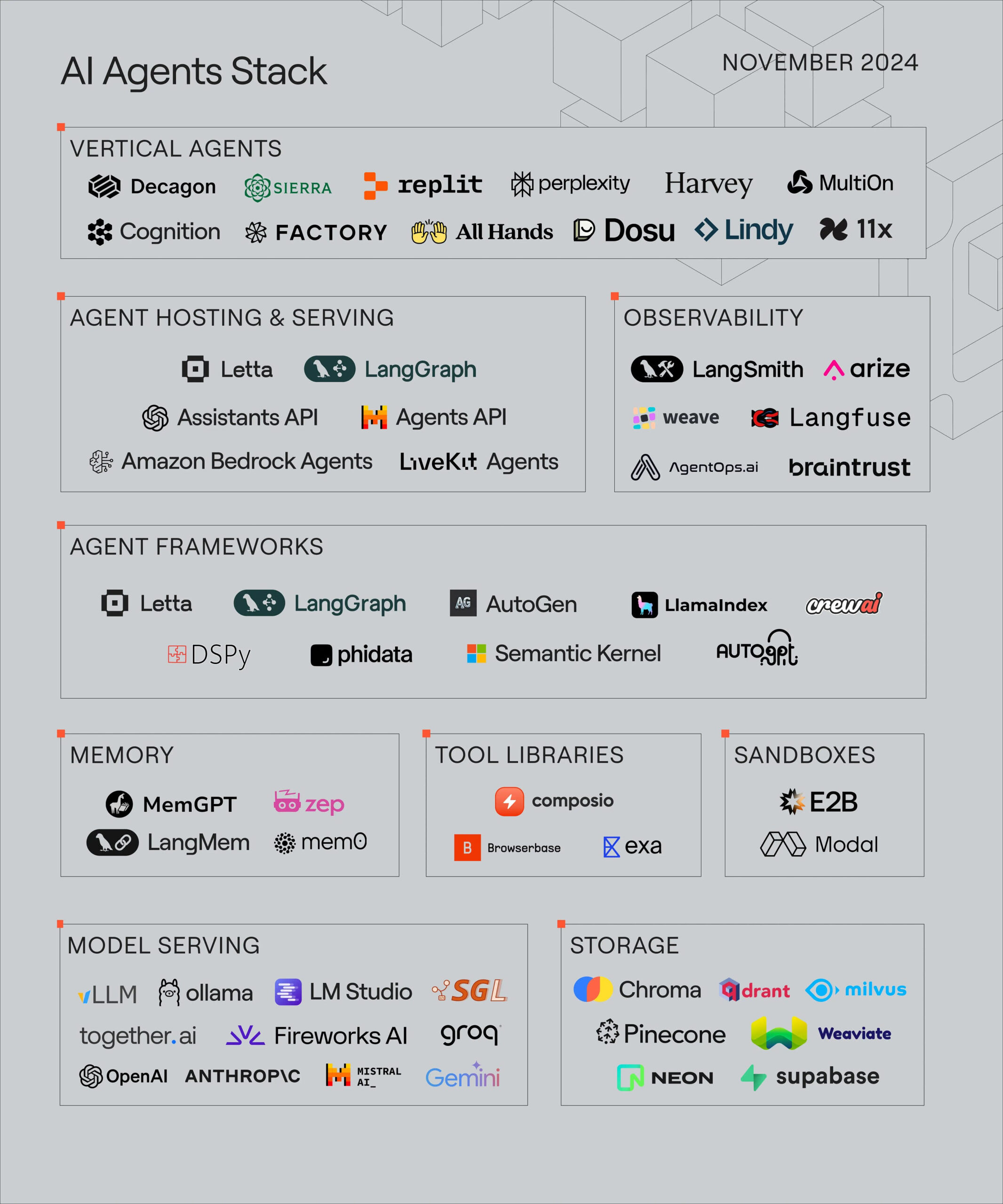

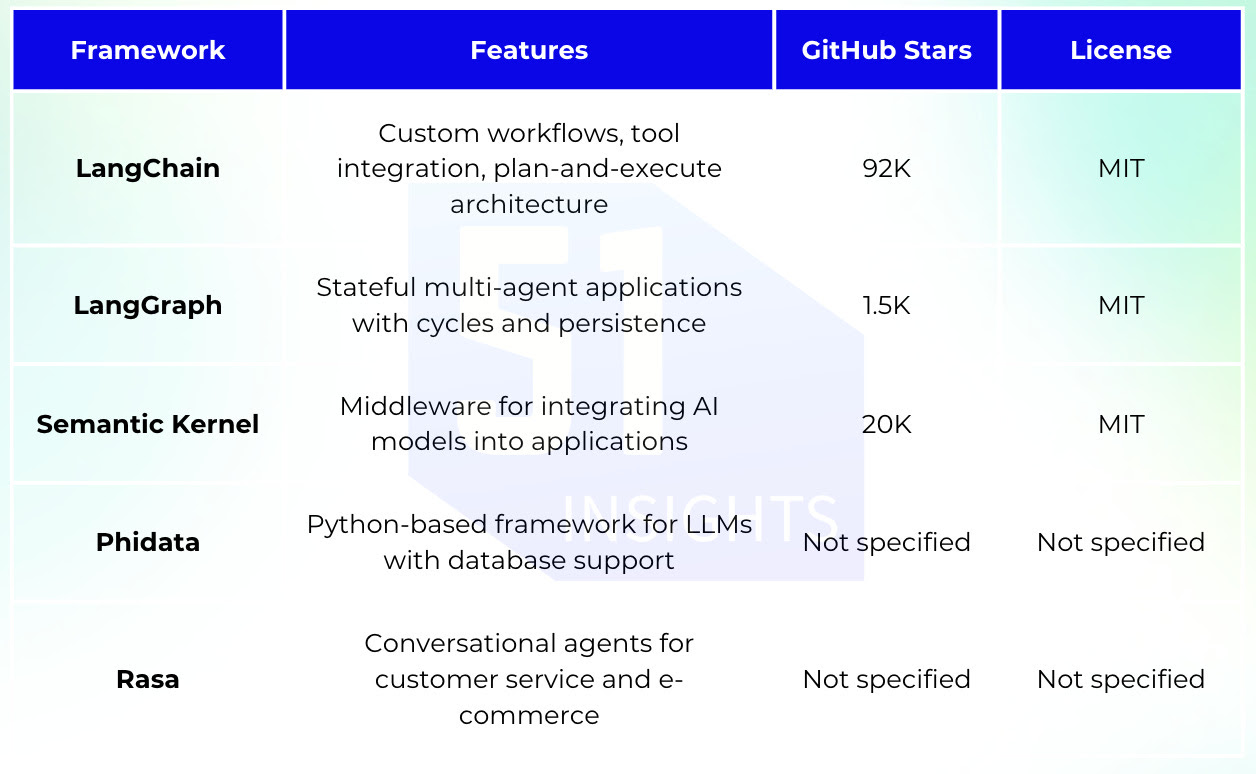

L’intelligenza artificiale sta spingendo oltre questa relazione. Non siamo più di fronte a macchine che aspettano input: siamo davanti a sistemi che imparano, elaborano, agiscono. Ed è qui che si apre una nuova fase, quella degli inter-agenti. Questi sistemi non si limitano a rispondere. Imparano. Anticipano. Suggeriscono. E in qualche modo, su nostra delega, “decidono”. Diventano partner attivi in grado di collaborare con noi. Non più un assistente che chiede: “Cosa posso fare?”, ma un agente che dice: “Ecco cosa ho preparato per te. È corretto?”

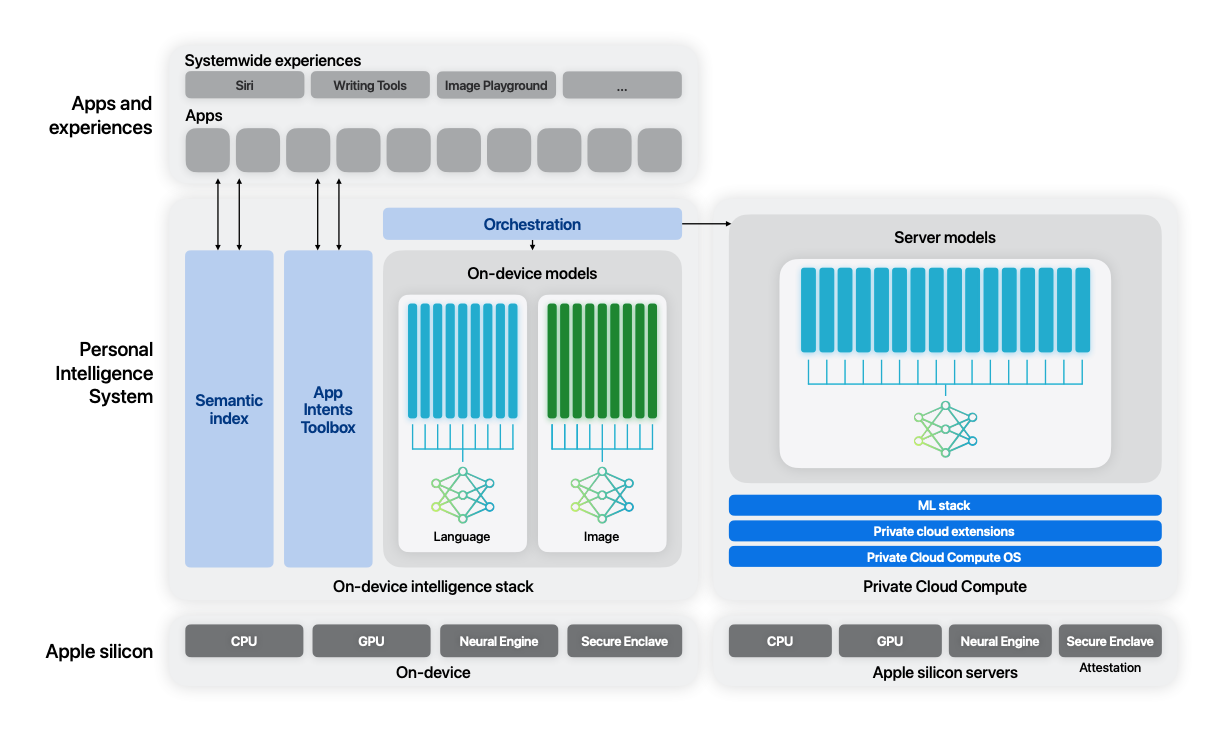

Prima di approfondire il tema degli inter-agenti, è fondamentale riconoscere come l’AI stia trasformando il paradigma dell’interazione. Non si tratta solo di migliorare l’usabilità: l’AI sta ridefinendo il modo in cui percepiamo la tecnologia, passando dal considerarla uno strumento al vederla come un’estensione della nostra capacità decisionale. È una relazione che evolve verso una simbiosi più profonda.

Questo cambiamento non è solo tecnologico: è ergonomico, culturale e sociale. La tecnologia non sta più influenzando solo ciò che facciamo, ma tocca da vicino il modo in cui pensiamo, prendiamo decisioni e organizziamo la nostra vita. Siamo pronti a delegare parte delle nostre decisioni a un sistema che ci conosce, che può – in molti casi – agire meglio di noi?

E qui si apre un dubbio interessante: se socialmente siamo portati a non fidarci del prossimo, riusciremo a farlo delle macchine? E se sì, potrebbe essere proprio la macchina il ponte per instaurare un legame di fiducia maggiore tra le persone, facilitando rapporti meno condizionati dai nostri pregiudizi? Oppure ci troveremo di fronte a un’amplificazione dei bias, radicati nei dati che alimentano gli algoritmi?

La differenza tra interattività e inter-agenzialità è profonda. L’interattività è un dialogo lineare: l’umano pone una domanda, la macchina risponde. L’inter-agenzialità, invece, è un ecosistema collaborativo tra due o più entità. Gli inter-agenti agiscono -dopo la nostra delega- autonomamente, interpretano il contesto, colgono necessità che non abbiamo nemmeno espresso. Questo rapporto amplifica le possibilità, ma richiede un nuovo equilibrio tra autonomia umana e autonomia tecnologica.

Non credo esistano ambiti in cui un concetto di questo tipo non possa essere applicato. Pensiamo a un agente che ottimizza il consumo energetico della casa: non si limita a eseguire un comando, ma ci aiuta a vivere in modo più sostenibile (ma lo fa solo quando incontra situazioni già passate e registrate nei dati). Oppure un assistente personale che non solo organizza il calendario degli appuntamenti, ma ci consiglia quando prenderci una pausa, perché ha notato che il nostro livello di stress è in aumento.

Questi sistemi non semplificano solo la vita. Ci abilitano. Ci permettono di concentrarci su ciò che conta davvero.

L’amico Massimo Chiriatti sottolinea spesso come la tecnologia non debba sostituirci, ma potenziarci esternalizzando alcune funzioni cognitive, per tale ragione ha avviato una ricerca multidisciplinare su Nature. Ed è qui che questa evoluzione mostra il suo vero valore: non dobbiamo sentirci privati del controllo, ma vedere l’opportunità di andare oltre i nostri limiti. Sistemi come questi ci stanno portando verso un cambio di prospettiva: meno esecuzione, più comprensione.

Dove ci porterà questa evoluzione? Quando gli inter-agenti inizieranno a collaborare tra loro, condividere informazioni e obiettivi, entreremo in un’era in cui l’efficienza sarà moltiplicata. Pensiamo a una rete di agenti che n un ospedale gestisce risorse, ottimizza turni e coordina diagnosi. O a una flotta di veicoli autonomi che riduce il traffico agendo in sinergia. Non è un futuro distante: è già il prossimo passo.

E se guardiamo ancora oltre? Esisterà l’agente consapevole, una tecnologia che non solo agisce, ma comprende? Che tipo di evoluzione possiamo aspettarci? Sarà una collaborazione ancora più profonda o un nuovo equilibrio da costruire?

Una cosa è certa: non stiamo solo evolvendo la tecnologia, stiamo ridefinendo il rapporto tra essere umano e macchina.

E questo, nel bene o nel male, potrebbe cambiare tutto.